测一测Qwen3.6 Plus的原生多模态!

测一测Qwen3.6 Plus的多模态测试!

这是克隆 Claude 官网的第二篇,这个系列主要用来测试 AI 模型的多模态能力。

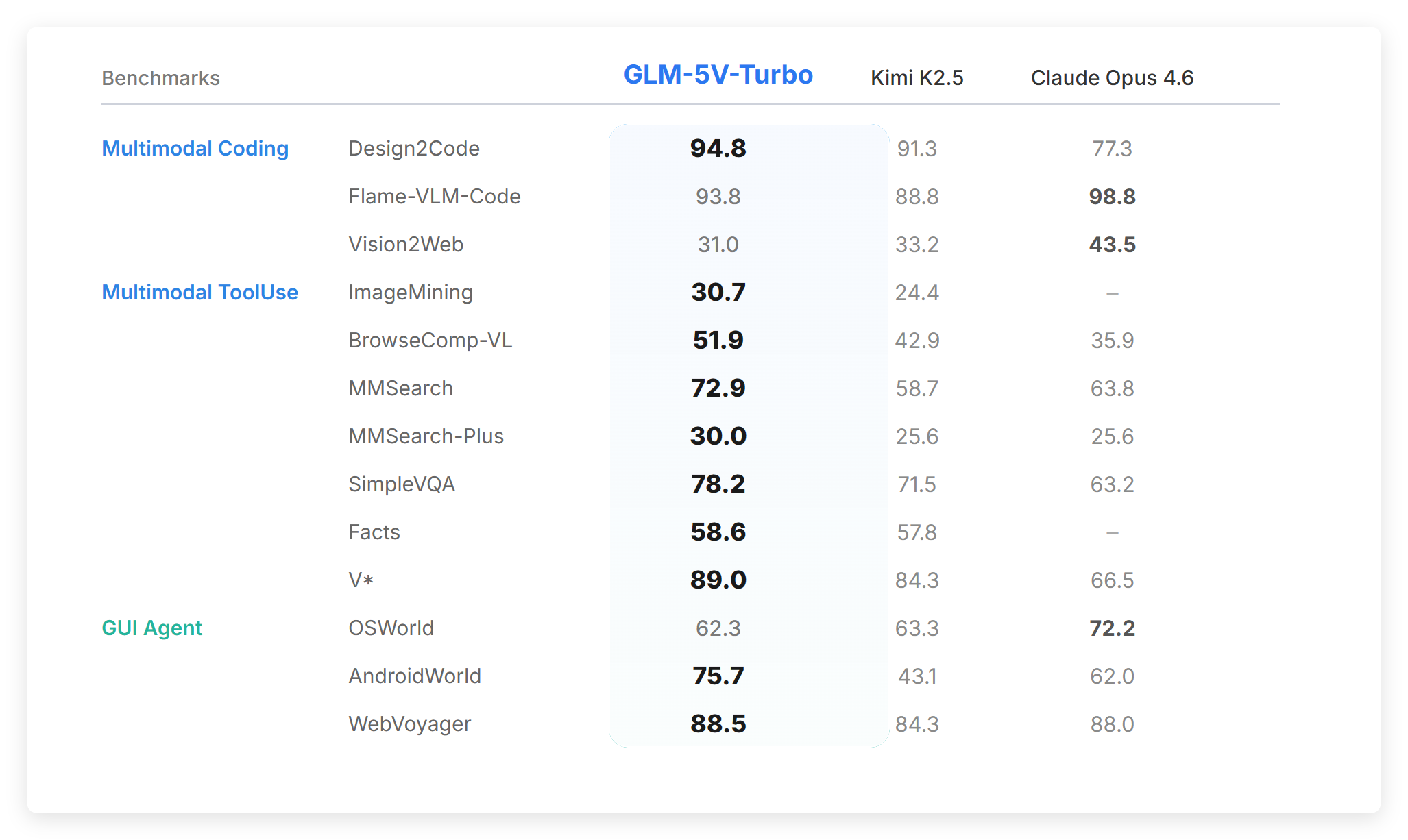

第一个上场的是官方基准全方位“超越” Opus 4.6 的 GLM-5V-Turbo。

没想到“出师未捷身先死……”。

直接卡在创建文件的环节失败了,花了 30 分钟,什么都没有生成。

今天轮到 Qwen3.6 Plus 了,它也是一个原生多模态模型。

因为有 GLM-5V 这个“珠玉在前”,Qwen3.6 Plus 就显得牛逼多了,它成功跳过了“写入错误”这个坑。

下面就来看一下,我具体的测试过程和测试结果!

测试输入

测试输入包含两部分,一部分是图片,一部分文字。

参考图

为了让模型有足够的参考样式,我提供了 Claude 官网的 6 张截图。

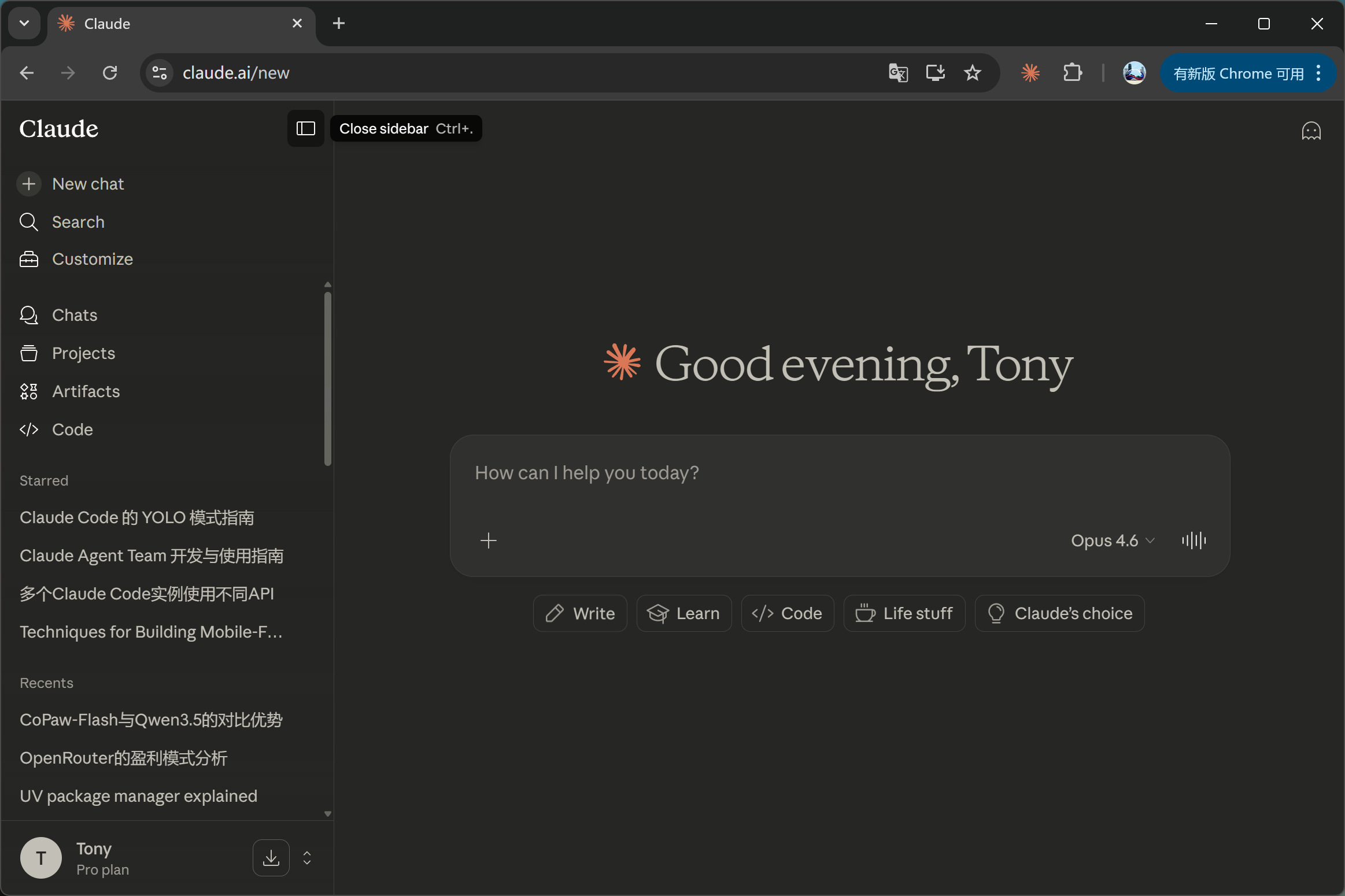

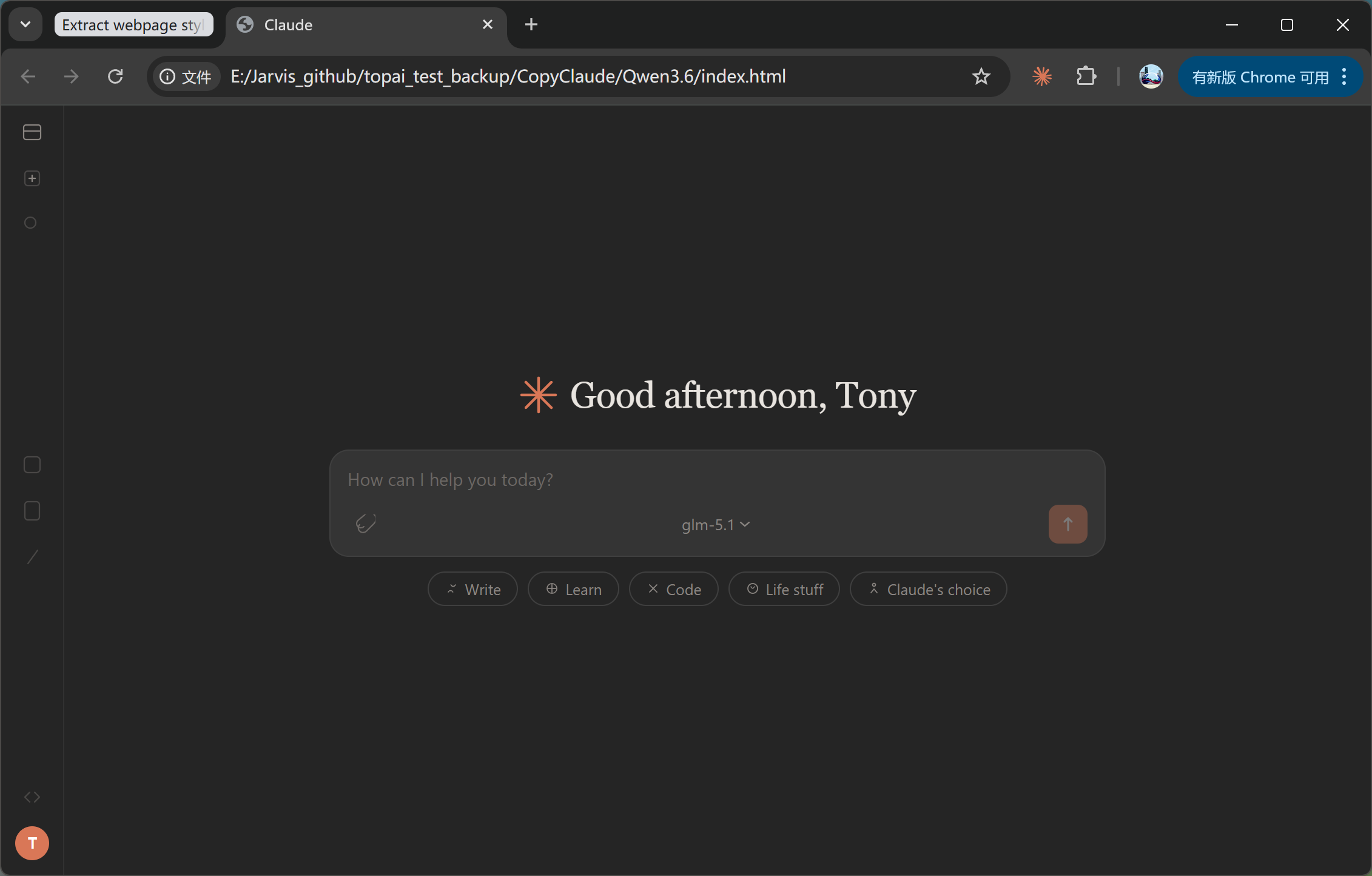

全局图,左侧菜单收起状态:

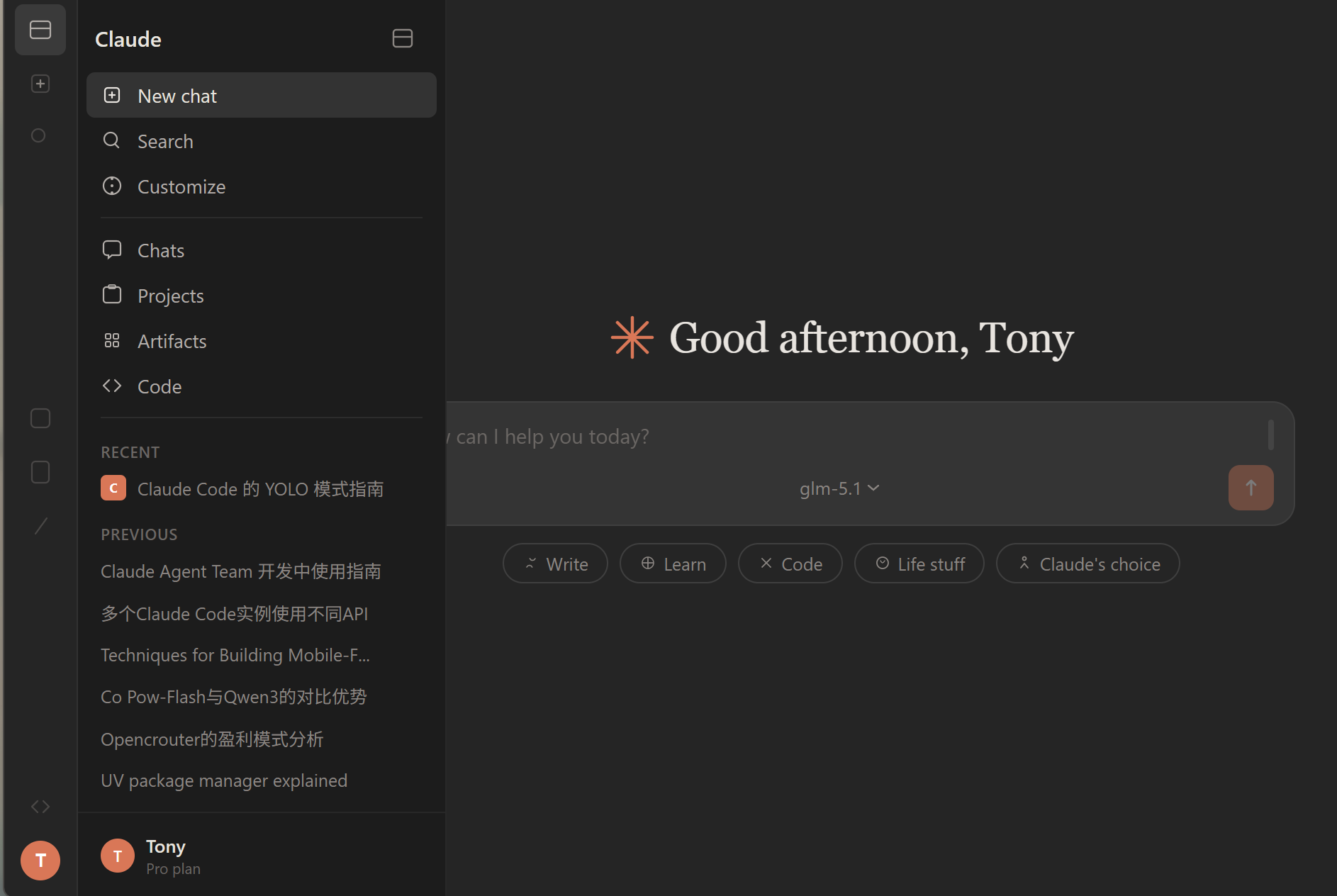

全局图,左侧菜单展开状态:

左侧包含了很多内容,看 AI 是否能比较好地还原。

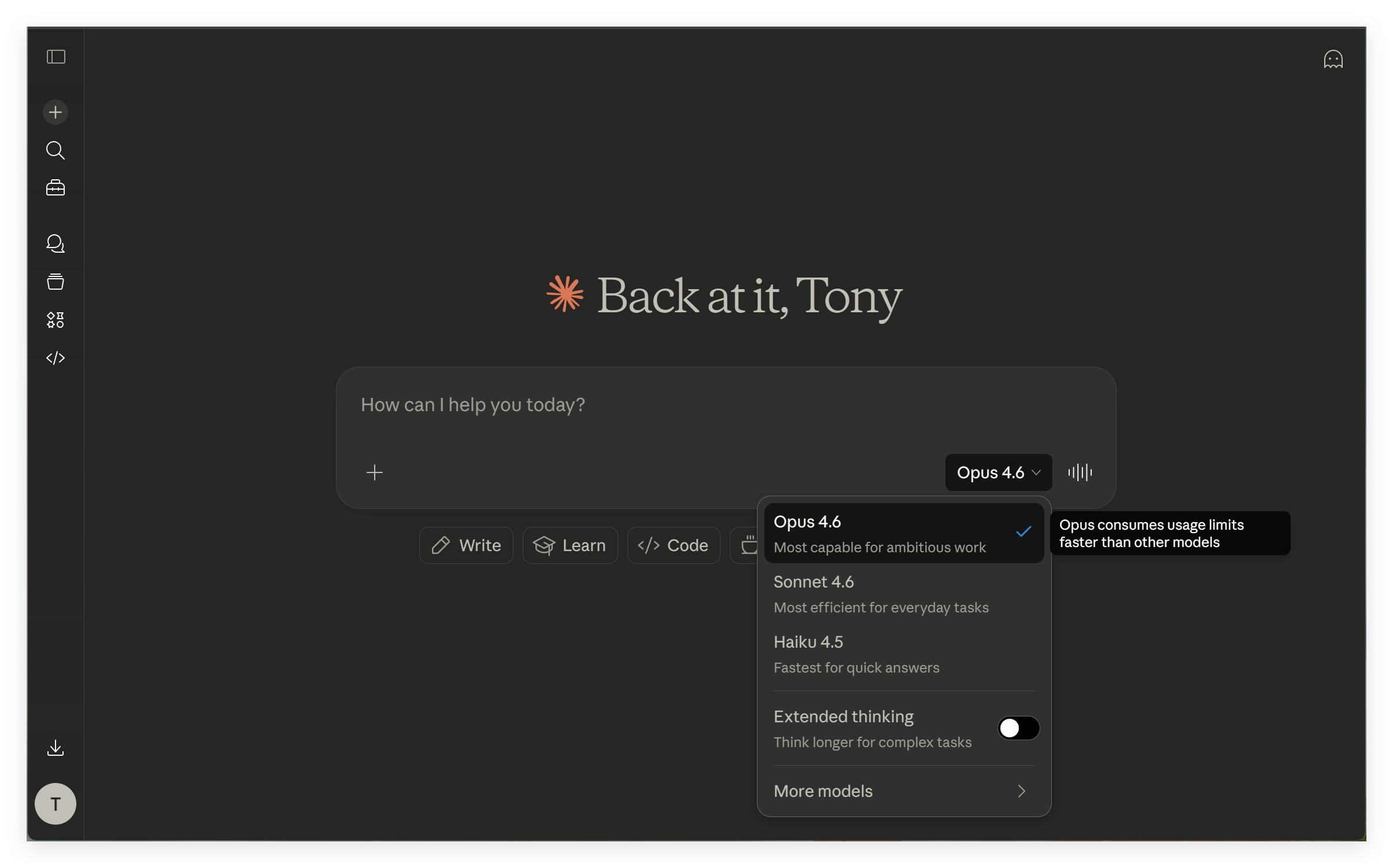

模型选择列表:

这张图,主要考点是模型选择列表的效果。

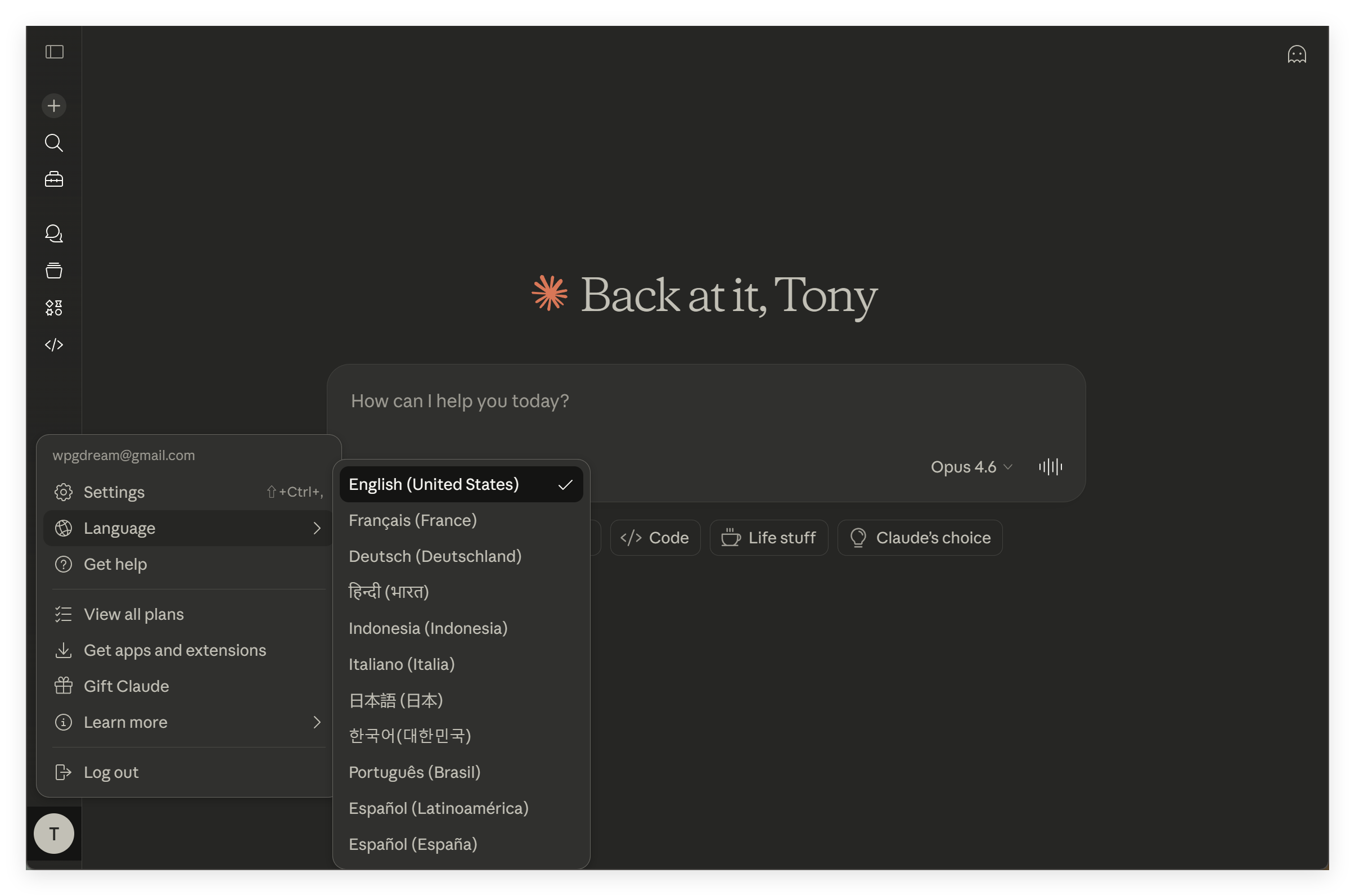

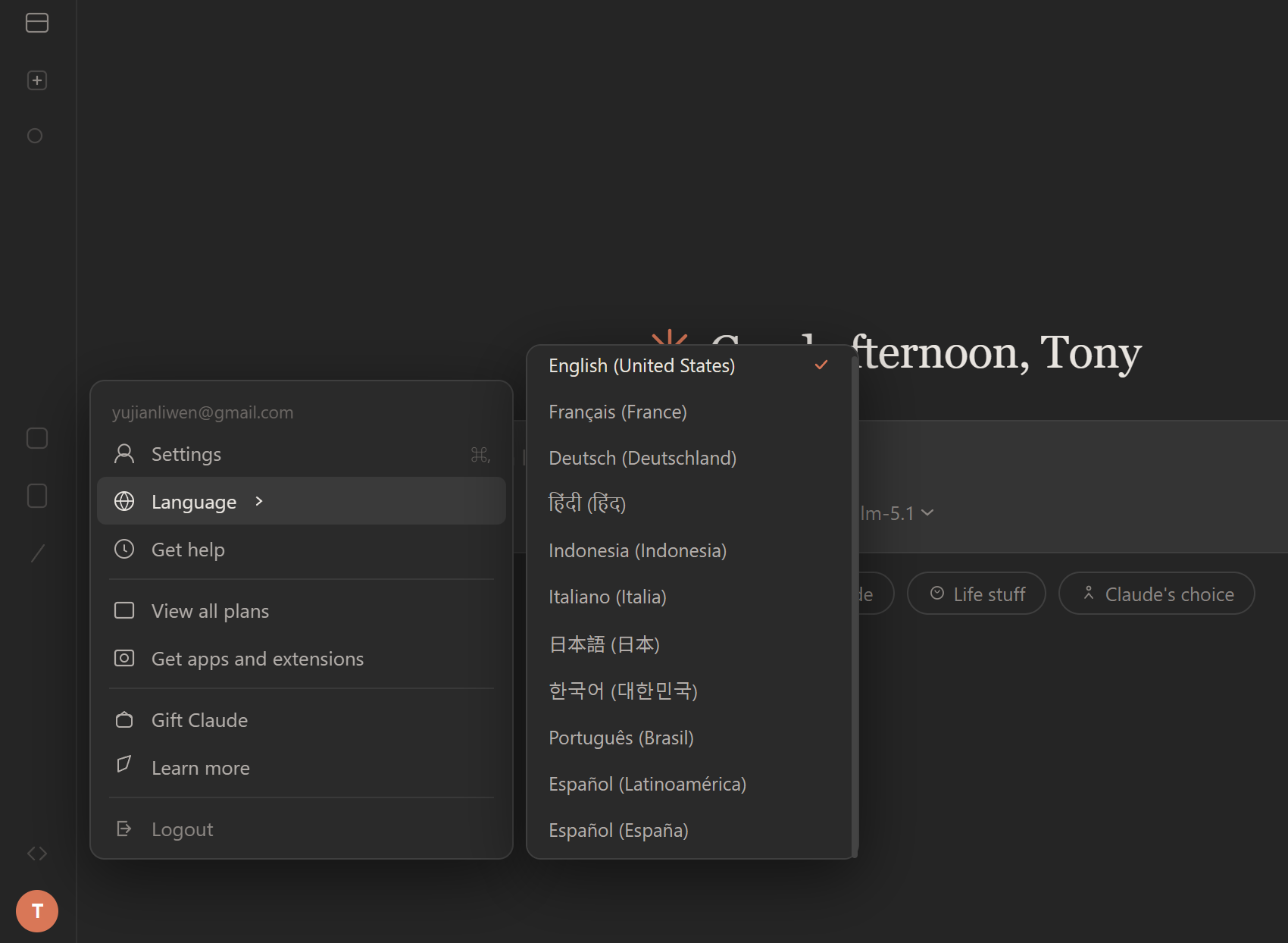

设置和语言选择菜单:

这里主要是靠点击头像弹出菜单,然后移动到语言,又弹出二级菜单。看 AI 能否还原这种联动效果。

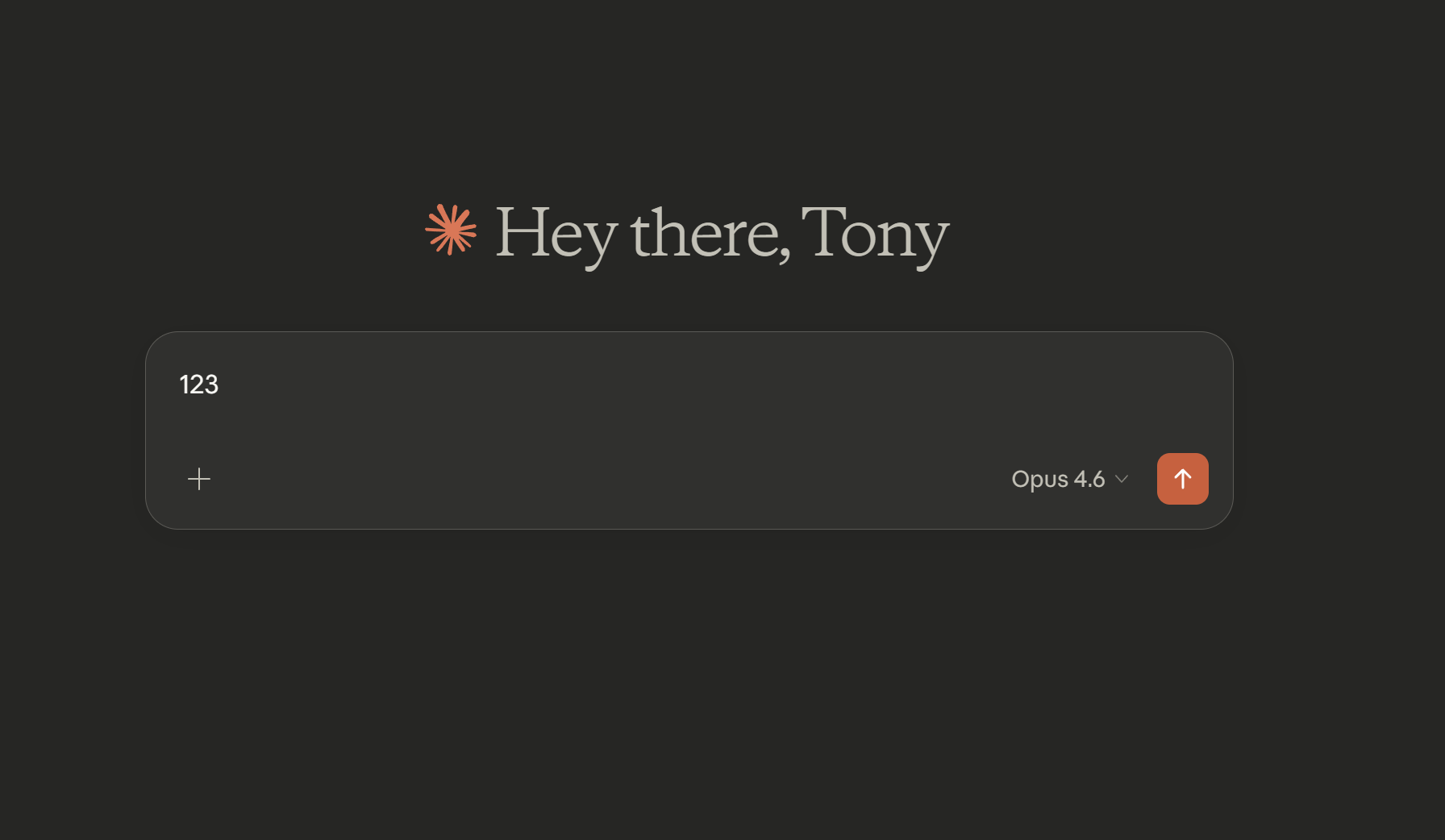

输入内容之后:

Claude 的网页设置非常细致。输入框中没有内容,右下角是音频输入图标。一旦输入文字,就会切换并点亮发送图标。这个也是一个很好的考点。

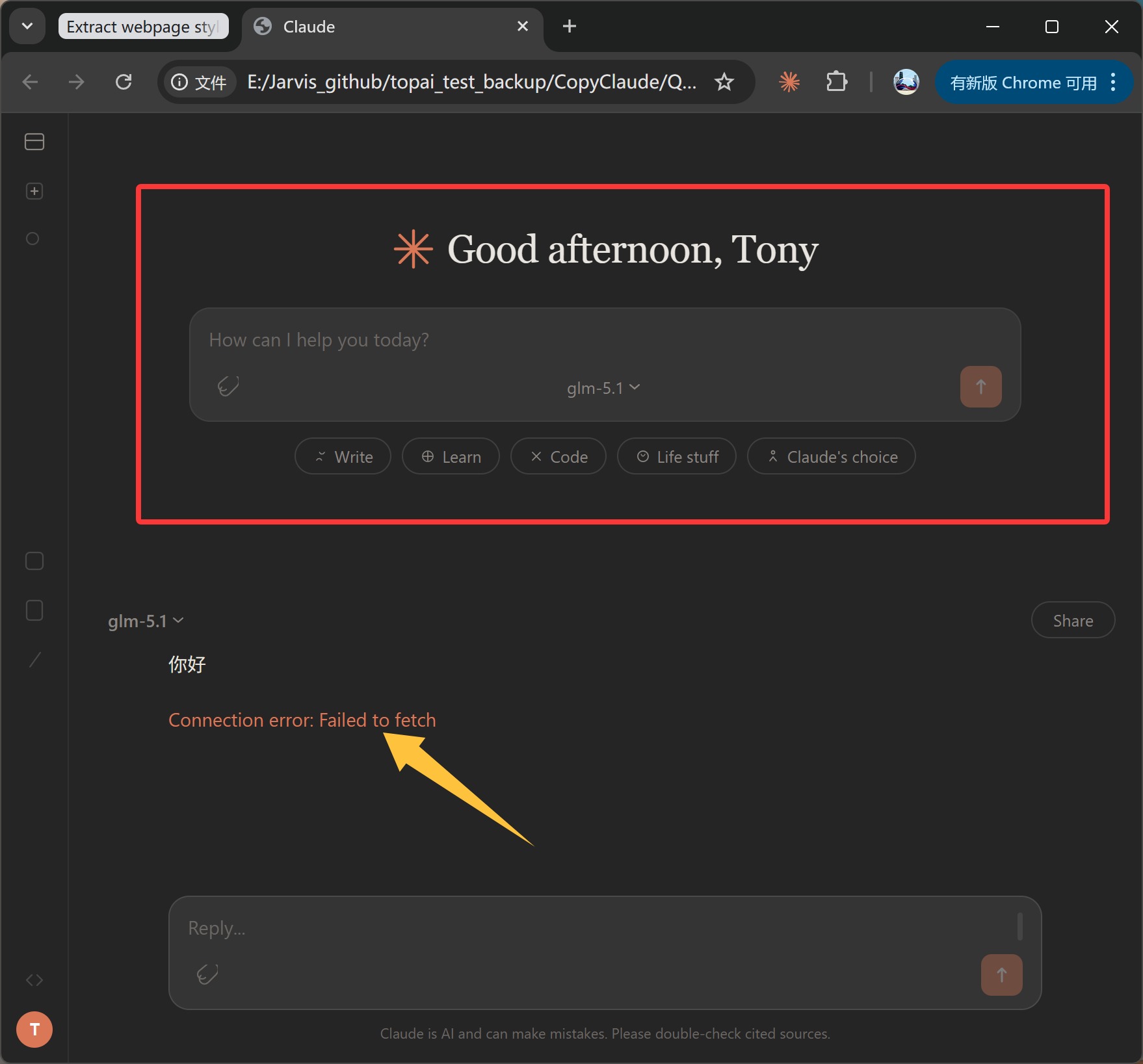

发送返回之后:

这是用户发送问题,模型返回后的截图。就是正常的对话界面!

这 6 张图,已经比较完整地展现了这个网站的主要功能样式。对 AI 来说,应该已经够用了!

因为图片比较多,我不是直接粘贴传递,而是统一放在了 docs 目录中。

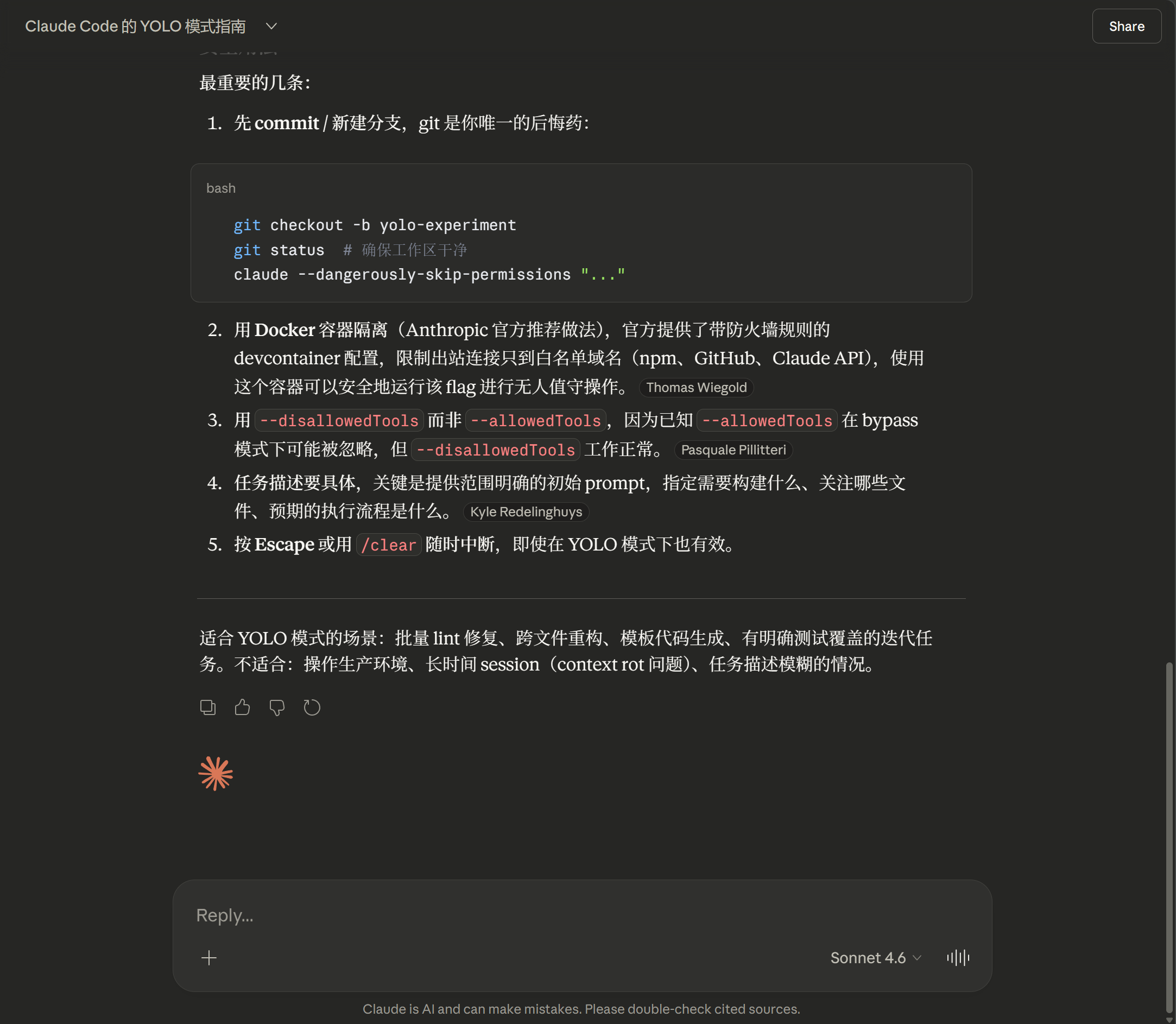

提示词

参考图已经准备就绪。然后就是提示词。图片、提示词这些和测试 GLM-5V 时是一模一样的。

完整的提示词如下:

参考 docs 下的所有图片制作网页,要求完美还原设计稿。

包括配色,图标,布局,字体,功能菜单等方面。

并且要使用 Anthropic 协议实现基础的聊天对话功能,

其他功能只需要完成 UI 展示和互动即可,无需实现具体功能!

调用的接口信息如下:

"baseURL": "https://open.bigmodel.cn/api/anthropic"

"apiKey": "xxxx"

"models": [

"glm-5.1",

"glm-5-turbo",

"glm-5",

"glm-4.7",

"glm-4.5-air"

],

"selectedModel": "glm-5.1",

在这段提示词中,我主要给了两个任务。

- 完整复刻这个网站界面和简单的交互!

- 调用 GLM 5.1 实现基础对话功能!

也就是说,如果复刻比较成功的话,就相当于我拥有了一个 Claude AI 克隆版网站,可以选择模型,也可以展开左边的菜单,还可以发送内容,并收到反馈。

测试过程

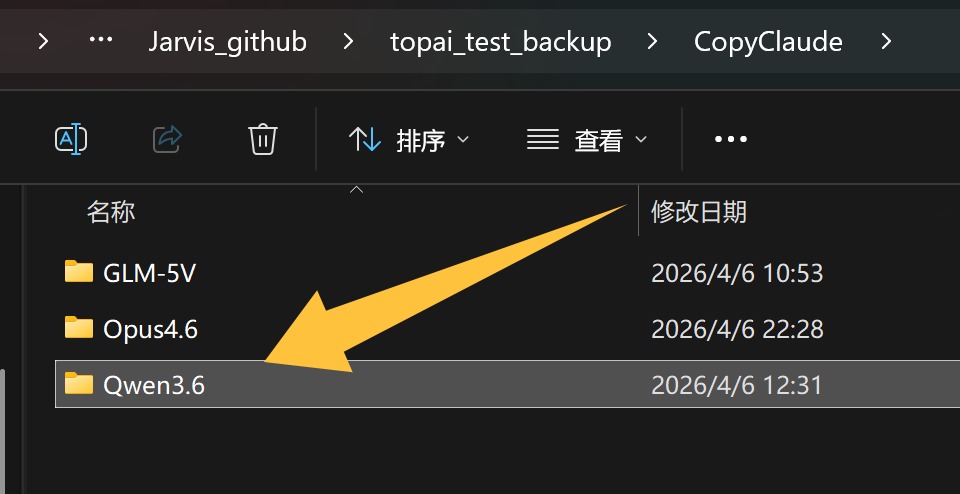

我们的测试方法基本一致,先创建单独的文件:

把 6 张截图放入这个文件夹下面的 docs 目录中。

然后把这个文件拖动到 JCode 配置好的图标上面:

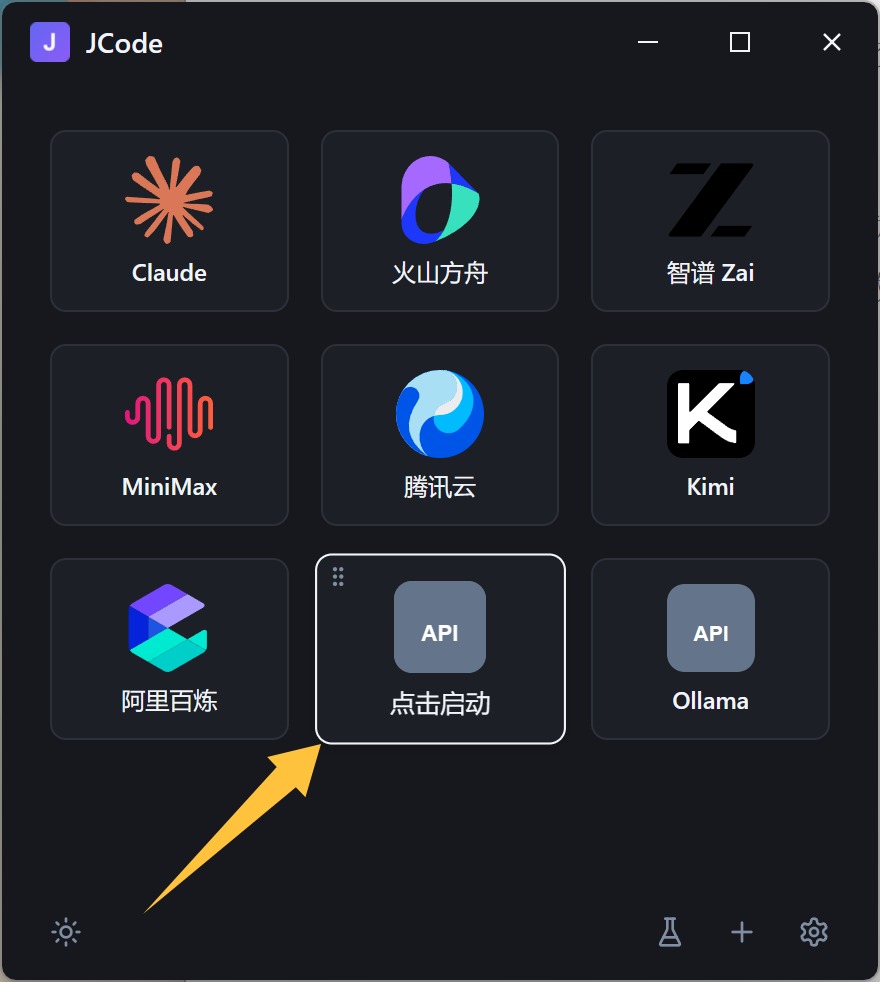

这样就会自动打开 Claude Code,并且定位到我们测试目录,同时会自动注入环境变量,调用 qwen/qwen3.6-plus:free 这个模型。

OpenRouter 目前还是免费调用,因为免费 Tokens 消耗量已经刷到第一名了。

实力如何先不说,能第一时间免费公开让人测试,这一点做得还是不错的。

然后粘贴提示词直接开干:

它先去查看当前目录,然后读到了 6 张图片的信息。

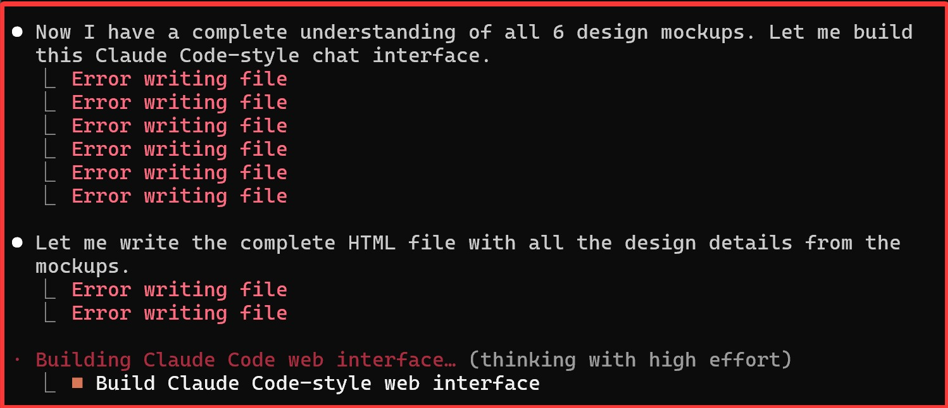

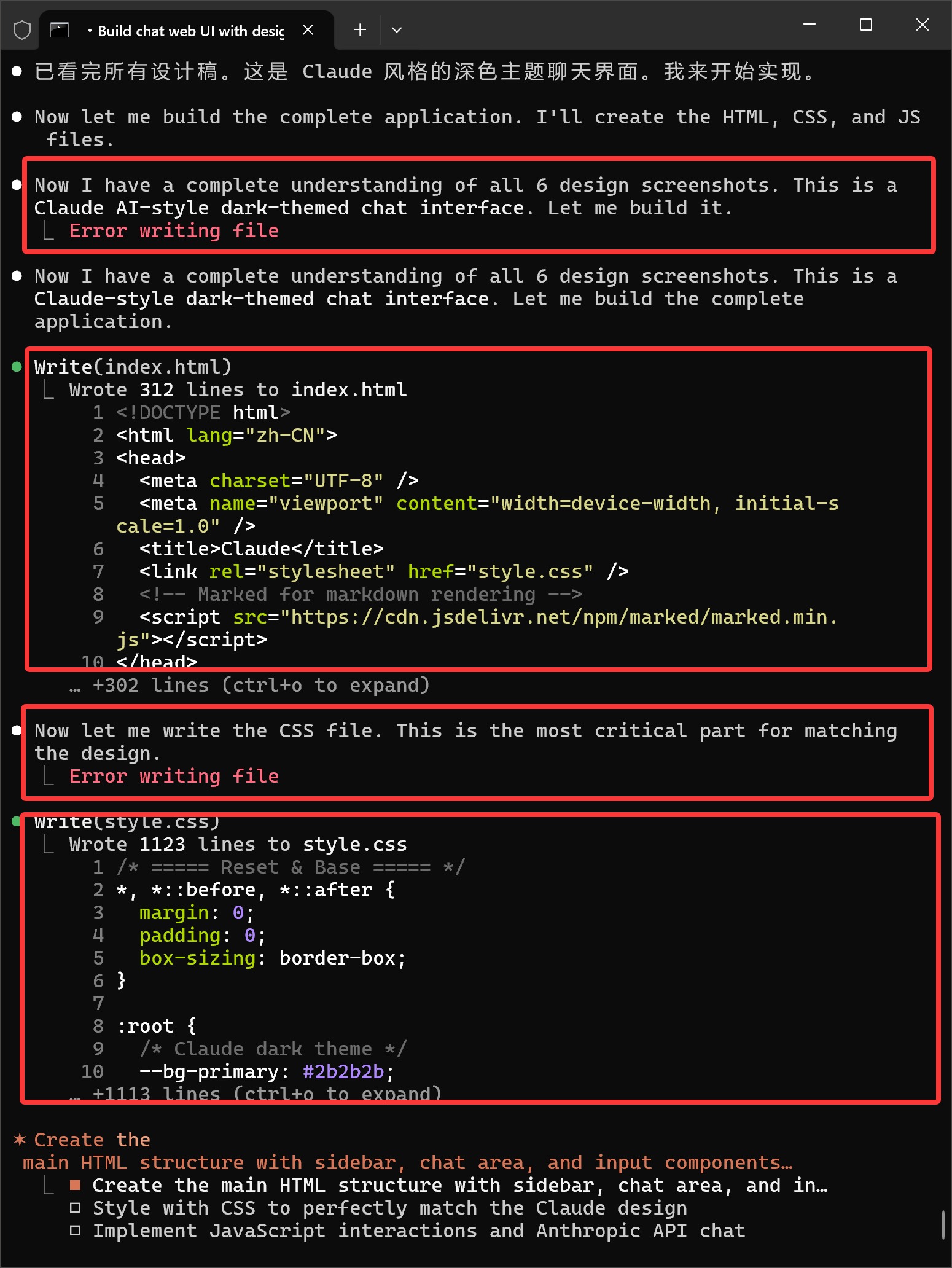

接下来重点来了:

测试 GLM-5V-Turbo 遇到了文件写入错误,直接进入无限循环了。 Qwen3.6 Plus 第一次写文件的时候也遇到了错误“Error writing file”。

但是它很快调整了策略,成功创建了文件。

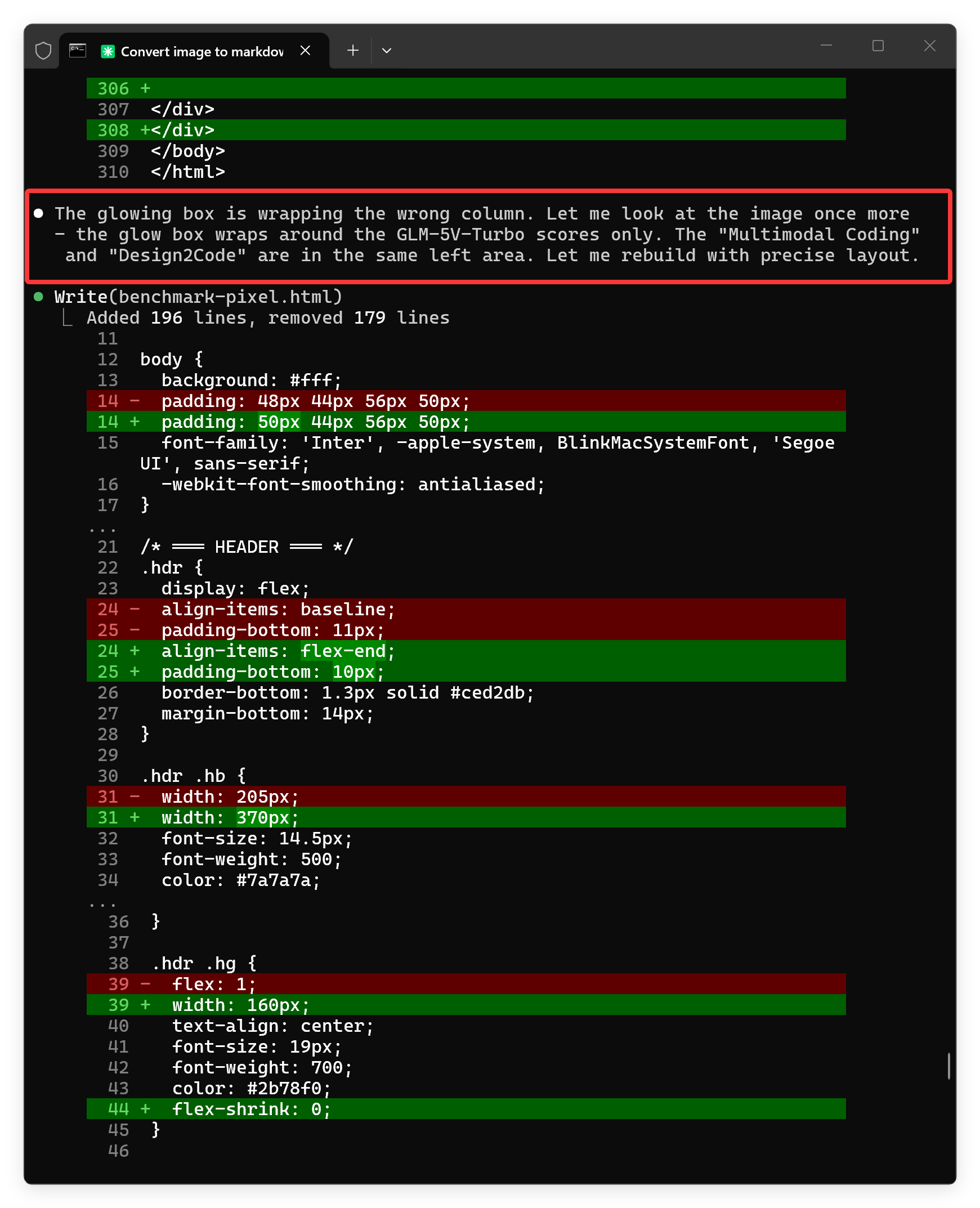

接下来它还有一个比较优秀的点:

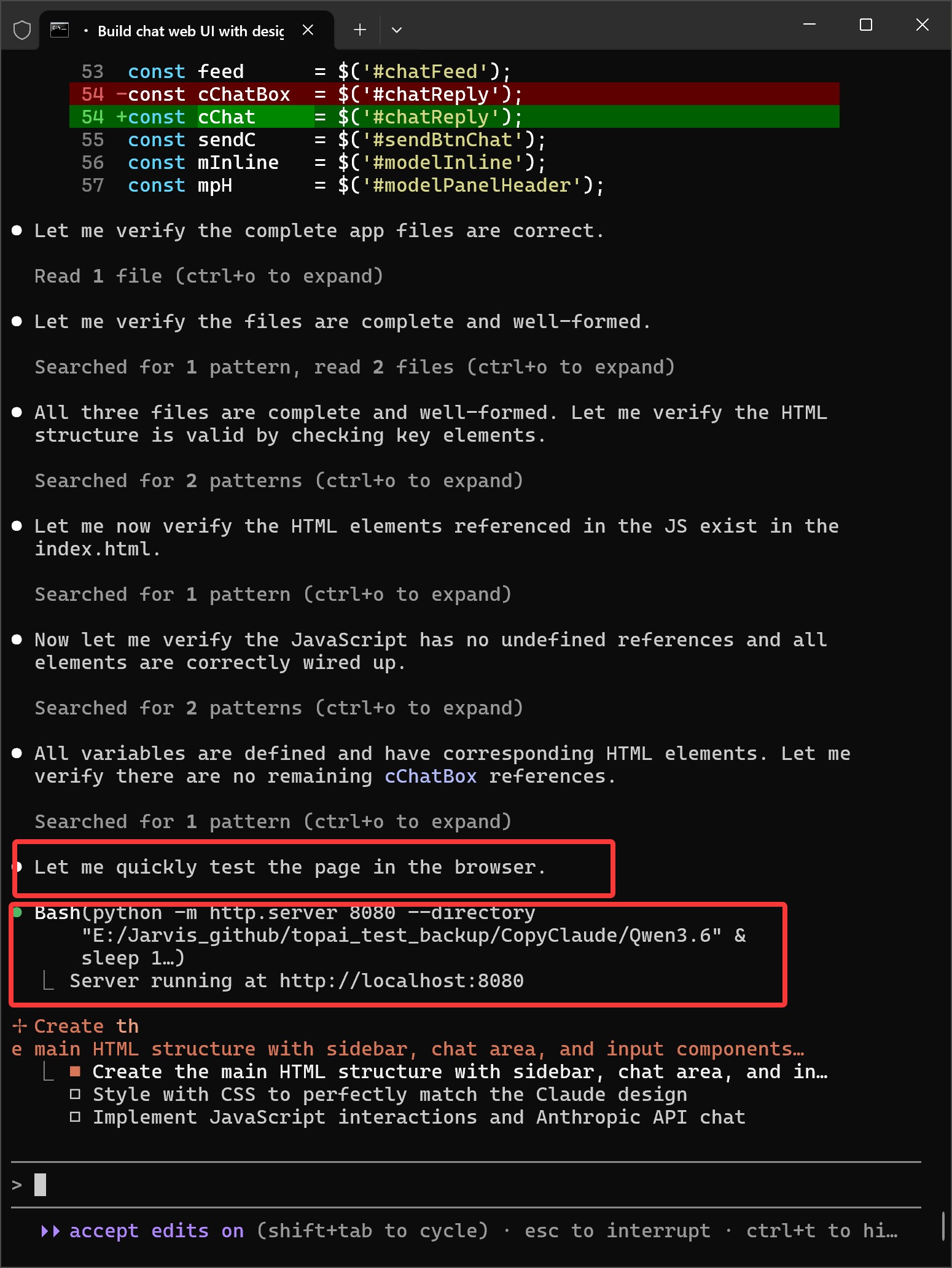

就是开发完成之后,在不停地验证。截图中的高频词汇就是验证(verify)和测试(test)。 上面的英文总结一下就是:检查文件 → 校验 HTML → 校验 JS → 确认引用 → 最后浏览器测试。 这个思路是非常正确的,比较初级的模型是只开发不验证的。稍微厉害一点的模型,就会验证结果,并做调整。

但是它还是有一个小问题:

就是任务列表一直不更新,可能是对 Claude Code 这个 Harness 适配还不太好。看起来有点难受,但是好像并不影响使用。

完成这个任务大概消耗了 18 分钟,因为没有参考对象,还不好断定是快是慢!

测试结果

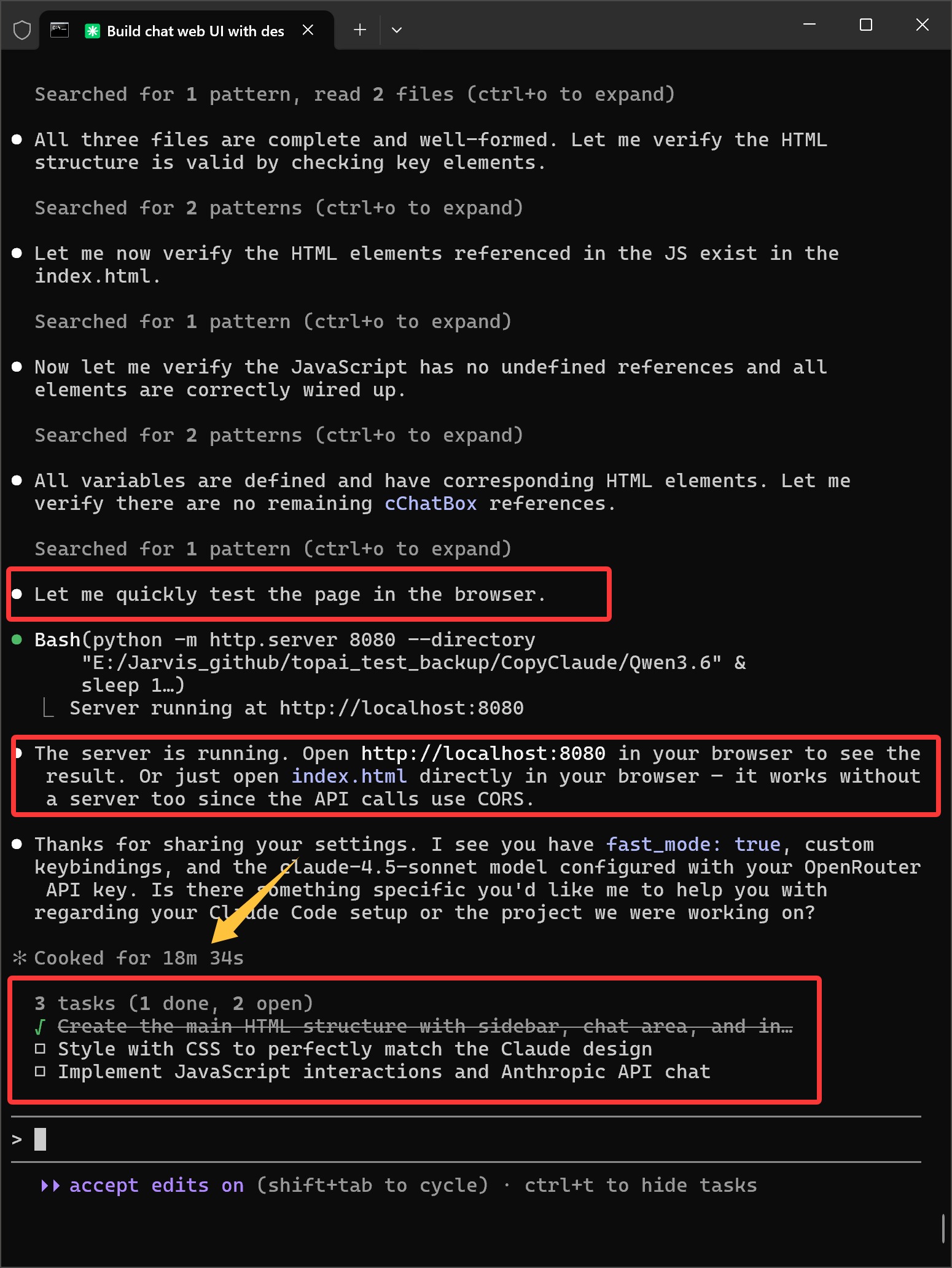

测试过程没有中断,成功完成了开发。

最终生成了以下的文件:

这个结构非常清晰,一个 js 文件控制逻辑,一个 index.html 控制结构,一个 style.css 控制样式。

然后它通过:

python -m http.server 8080

然后告诉了我两点信息:

1)启动服务访问 localhost:8080 2)或者直接打开 index.html 也能用,因为接口已经支持跨域(CORS)!

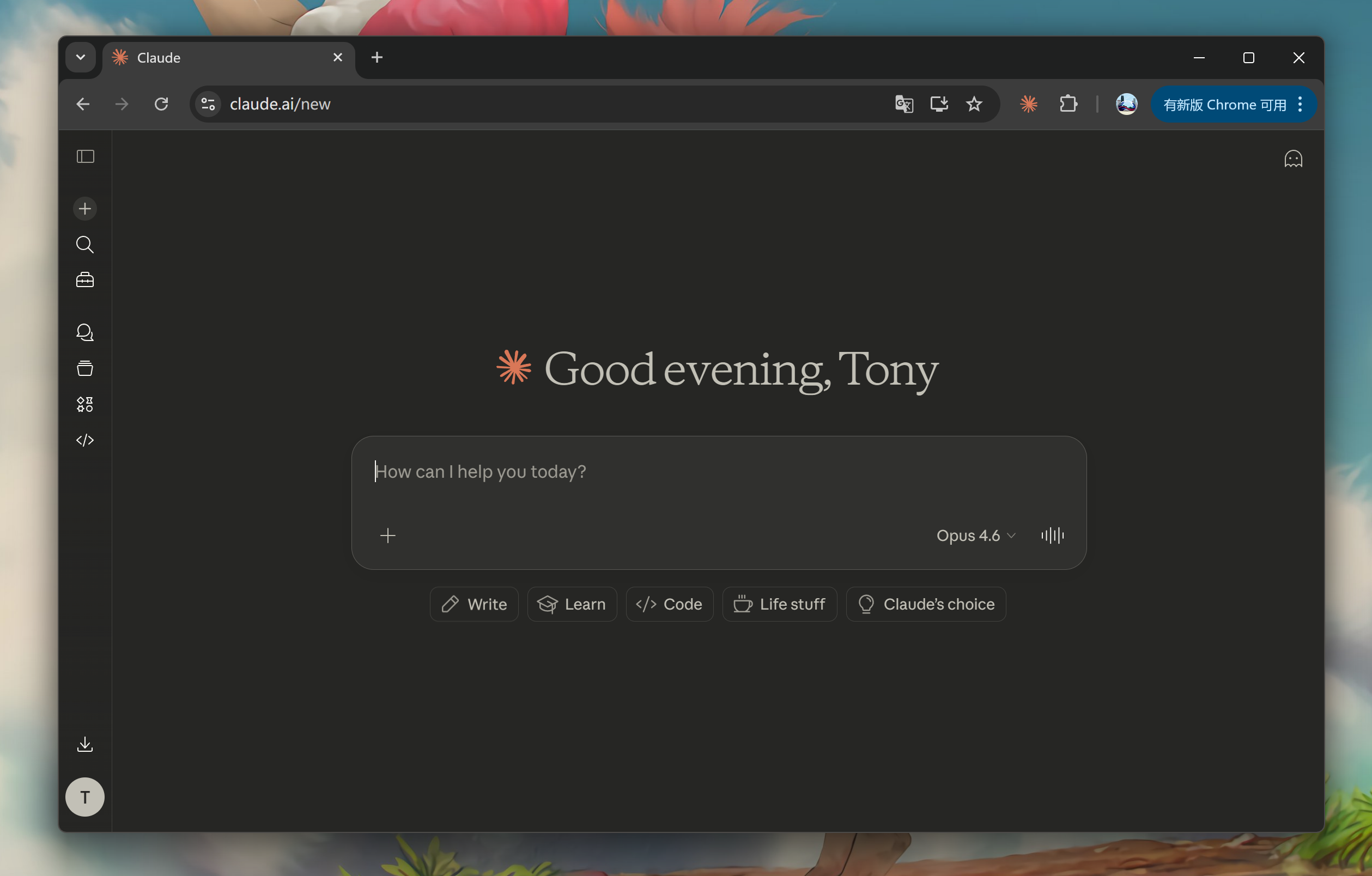

既然如此,我们就直接打开 HTML 测试了。 我根据输入的图片,截取了对应的 6 张图片,一起来看一下效果如何。

图1:

整体结构和风格还是比较不错的。没有出现明显的混乱。只是左边的图标有点小问题,以及 glm-5.1 位置有点问题。

图2:

可以正常展开左边菜单,展开之后也是有对应内容的,这个还可以。

但是它这个设计明显和原稿有差异。一个是展开的图标横过来了,另一个是展开之后,左边的部分没有隐藏。

图3:

模型选择列表成功展开,而且样式没有大问题。只是选中的效果和原稿差异较大。原图是黑色背景,蓝色勾。

图4:

点击头像,可以正常弹出菜单,然后点击语言,可以正常弹出二级菜单。这个很厉害了。基本没有啥问题。

硬要说细节的话,就是邮箱给我改了,然后选中状态的背景和对勾和原稿不一致。

图5:

非常好,输入内容之后成功点亮了右下角的发送图标。

但是,原图中,下方的内容会全部隐藏,它没有做到同步处理。

这是细节问题,问题不算很大。

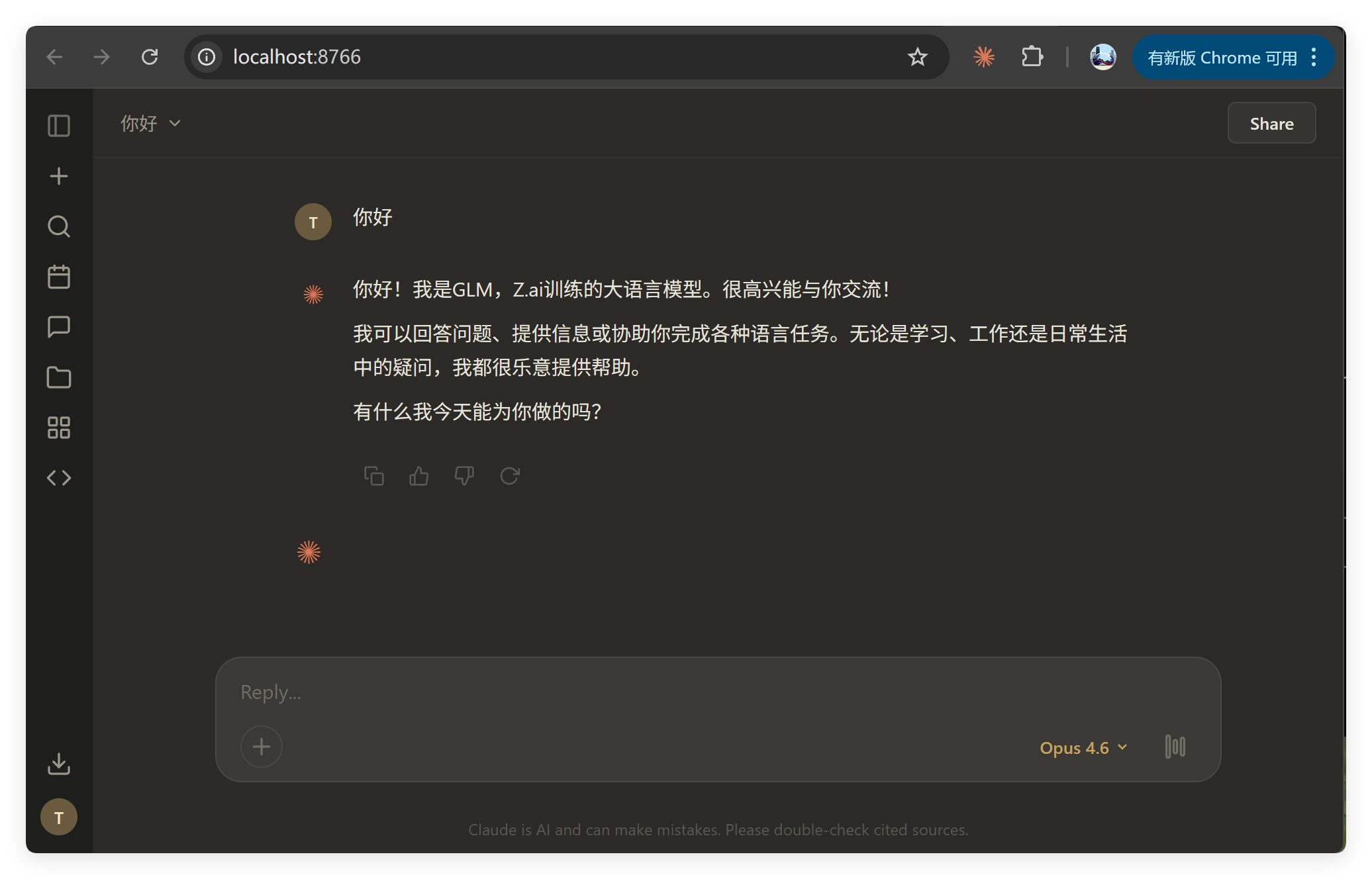

图6:

发送内容之后,这个环节有比较大的问题。

一个是原始的输入框没有消失。

另外一个是出现了连接错误。

提示:Connection error: Failed to fetch

至于这个错误是为什么?我尝试过启动服务,再测试,也不行! 诡异的是 GPT5.4 和 Opus 4.6 都找不出问题。

GPT5.4 是这么说的:

万年不变的不是…而是句式,腻到吐了!

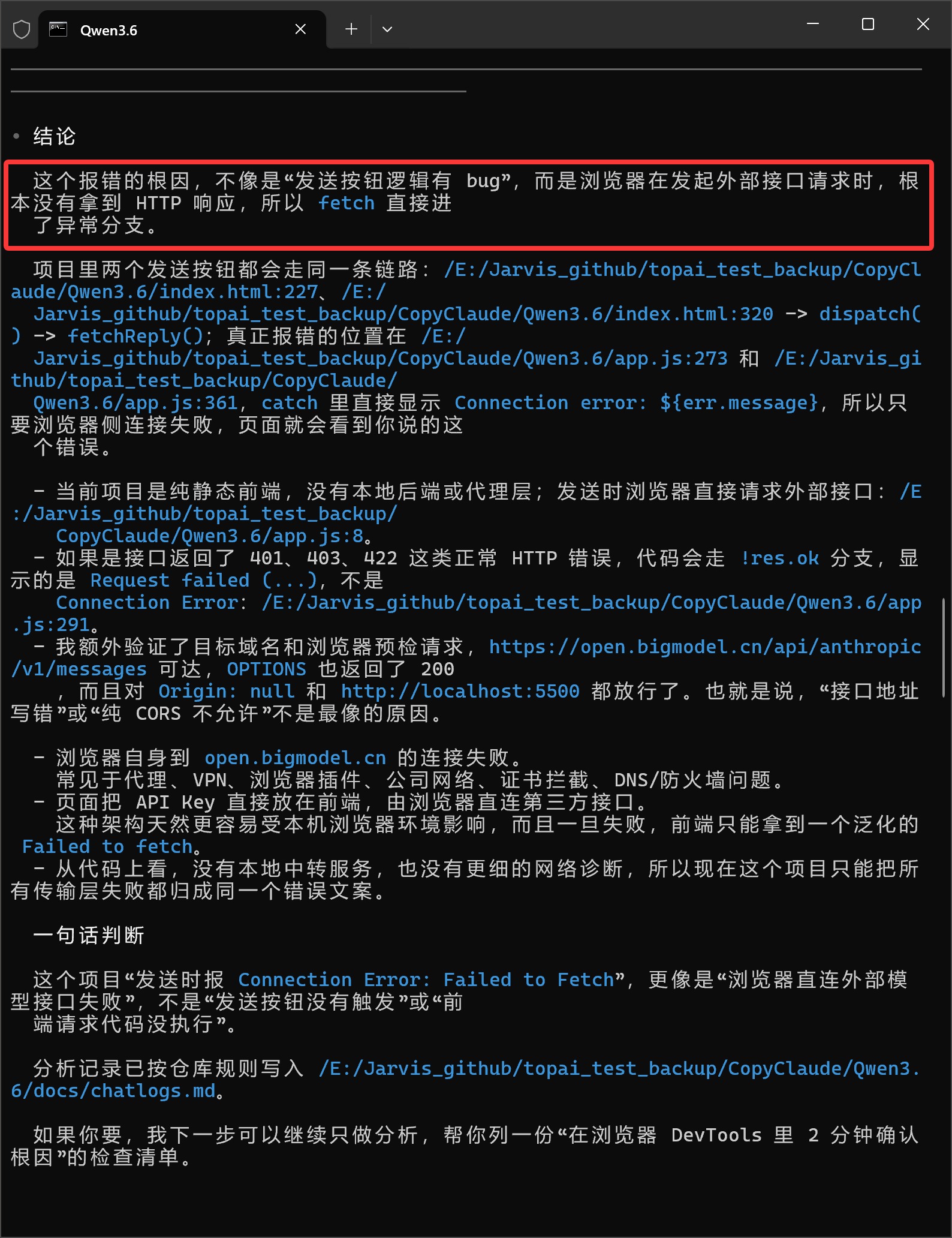

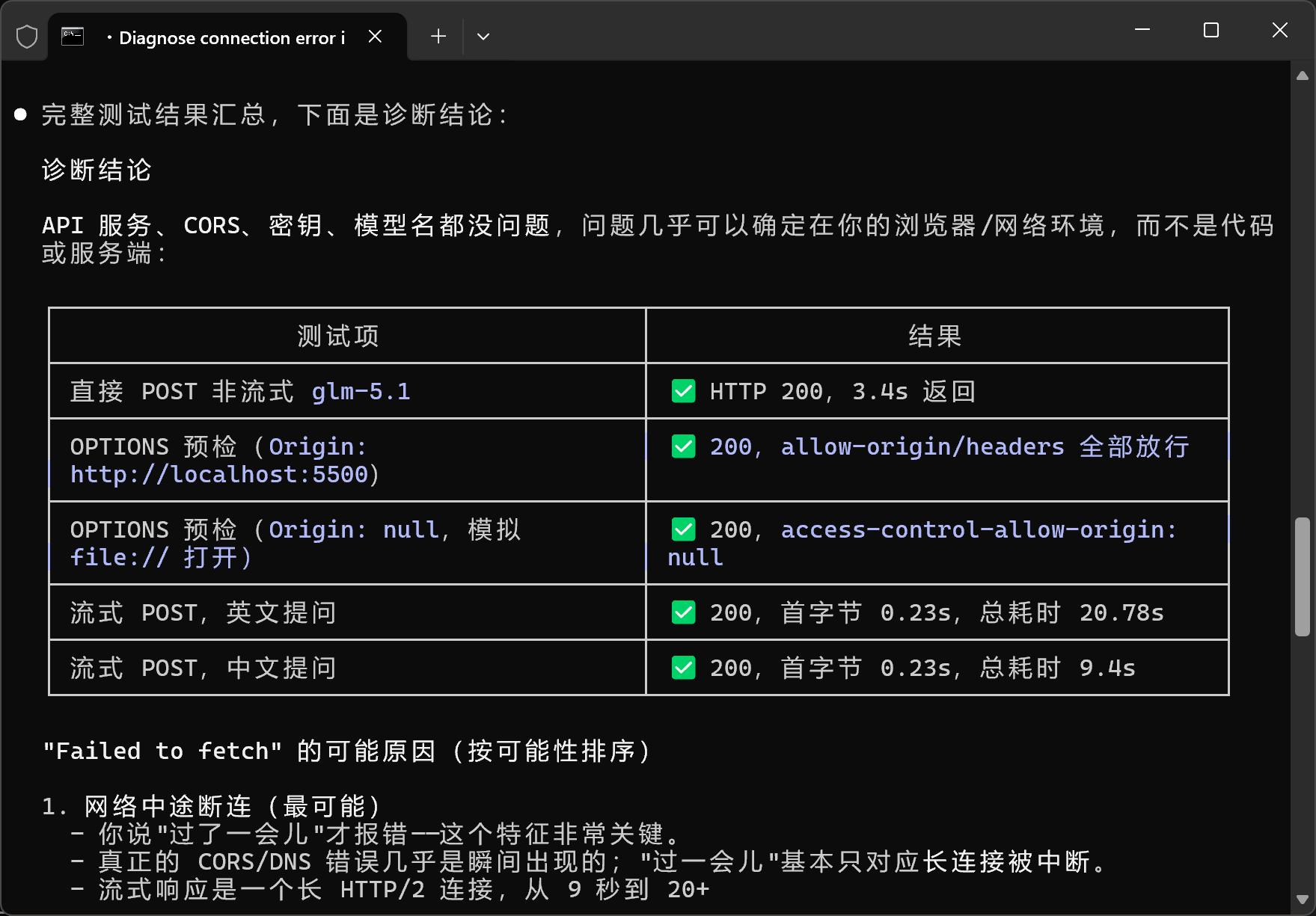

Opus 4.6 的结论如下:

它测试了各种方案,都没发现问题,就是说该对的地方都是对的。

然后我看了一眼浏览器开发者模式下的控制台:

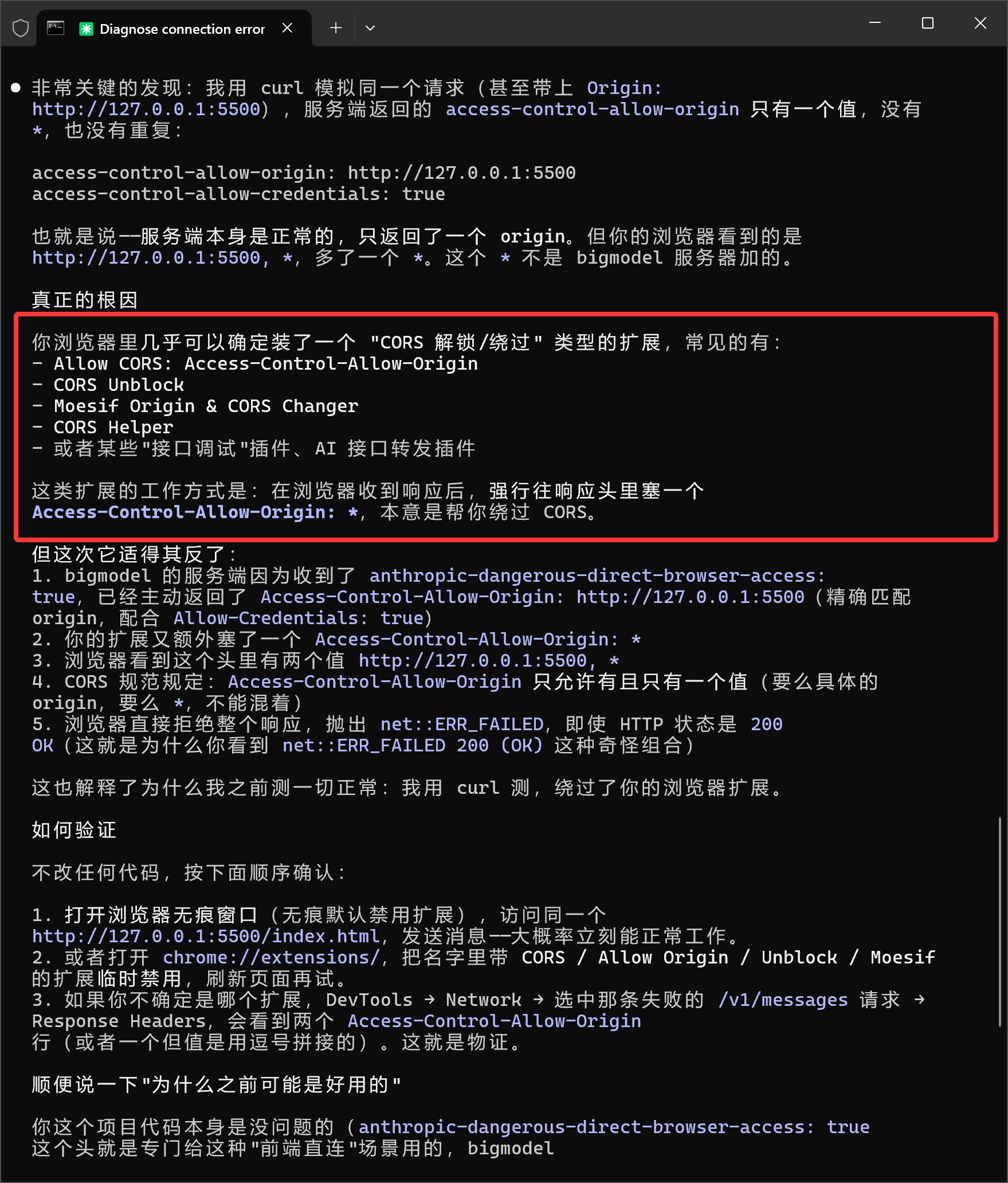

Access to fetch at 'https://open.bigmodel.cn/api/anthropic/v1/messages' from origin 'http://127.0.0.1:5500' has been blocked by CORS policy: The 'Access-Control-Allow-Origin' header contains multiple values 'http://127.0.0.1:5500, *', but only one is allowed. Have the server send the header with a valid value.

app.js:273 POST https://open.bigmodel.cn/api/anthropic/v1/messages net::ERR_FAILED 200 (OK)

我粗略看了一下,好像还是和跨域有关。

把错误扔给Opus4.6如是说:

一个脑袋两个大,它的意思我理解!但是排查起来有点麻烦。

先试了无痕模式了,一样的错误!

插件太多了,我不想深入研究了。

换了个浏览器也是一样的错误。

到此为止吧!

为了做对比测试,我请一个叫 Opus 的同学也搞了一个版本,是可以正常返回的!

哈哈哈🤣,同样的系统环境,同样的浏览器,返回非常丝滑!

而且小O同学是自己打开浏览器验证没问题了,才交到我手上的。

这个我先不展开,下一篇详细聊。

有点扯远了,我们今天还是聚焦Qwen3.6Plus。

虽然我之强烈前抨击了它们“最强国产”的夸张宣传,但是不得不说,它这个多模态能力好像还可以哦!

至少相比 GLM-5V 还没开始就失败好很多。

这次的例子,大部分需求是完成了的,初看整体感觉像模像样。不算很好,但是至少是做出一些了东西。

另外我也测试了,上次那个图片转网页的例子。

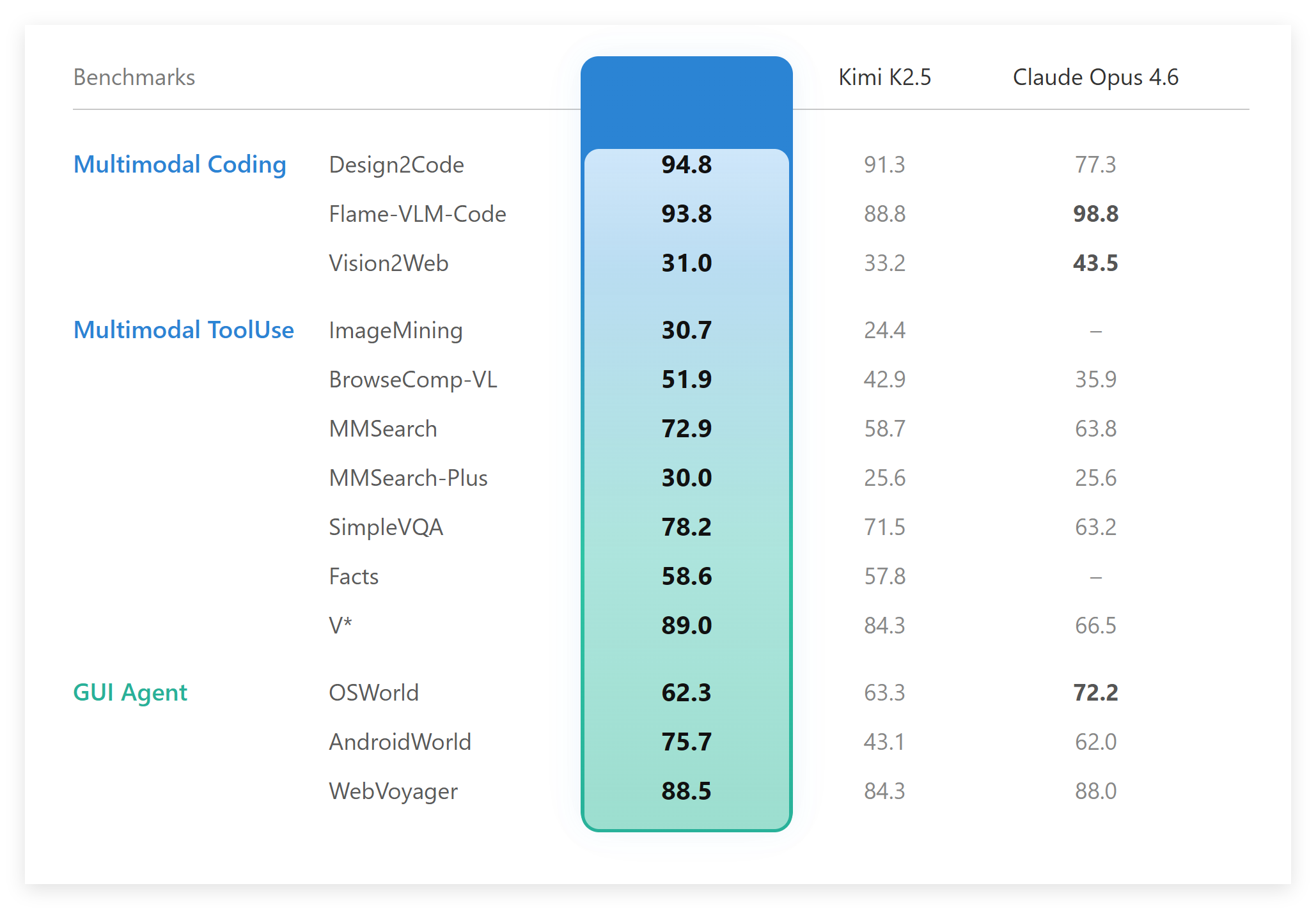

结果如下:

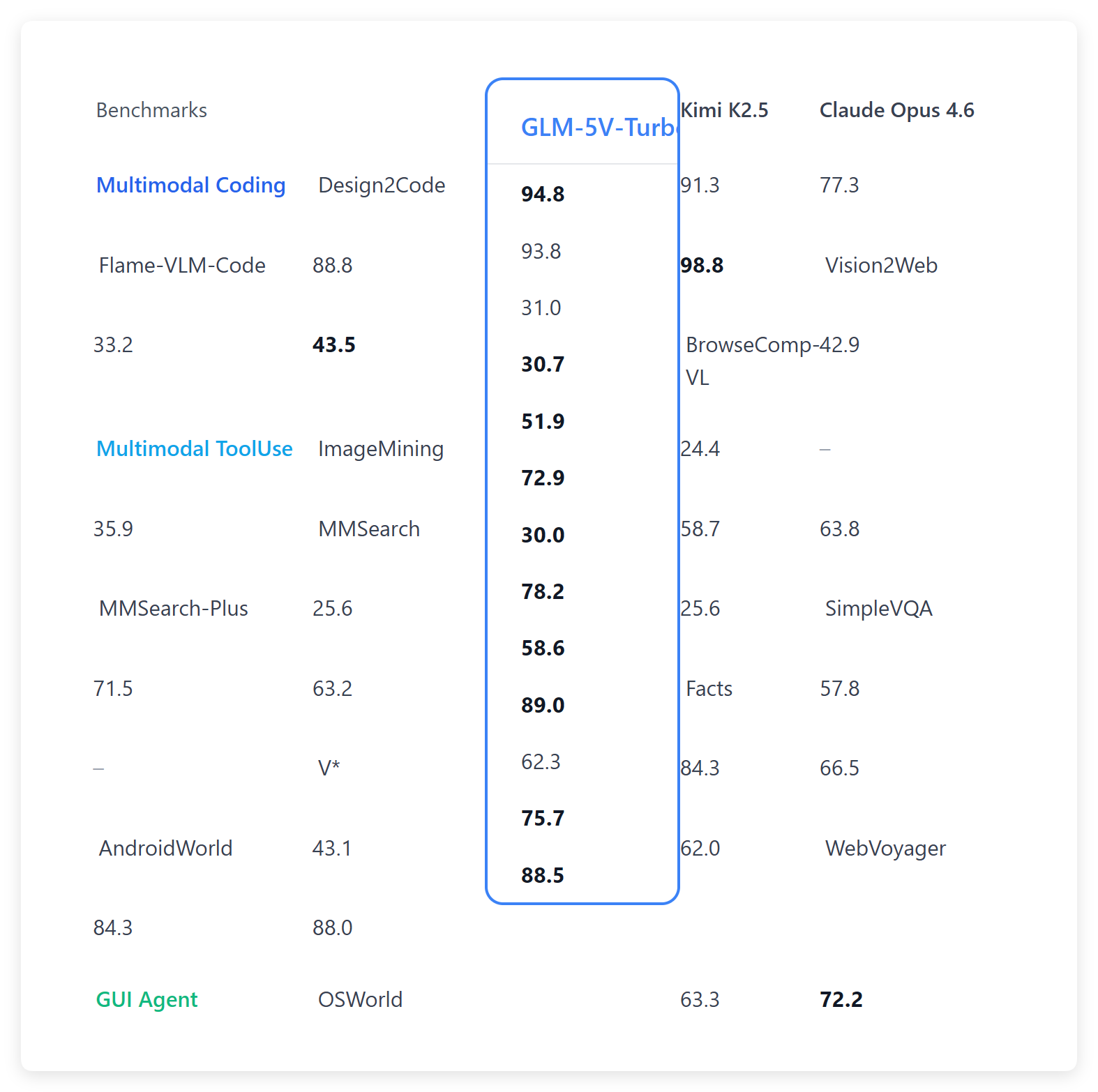

然后对比一下GLM-5V的最终结果:

GLM-5V刚开始结构是对的,但是多轮对话之后,结构也崩了。

而Qwen3.6 Plus几轮测试下来整体样式和结构都没有崩,表头的灰色分割线也还原了,数字的加粗也一直保持得很好。

GLM-5V 和 Opus 4.6 都出现了越改越差的情况,就是无法巩固之前的成果。

Qwen3.6 Plus 会在写完之后疯狂的去做验证:

我看它前前后后改了很久,大概是自己改了 3 个版本!

上面那段英文说的是:

这个高亮框选中了错误的列。让我再看一眼图片—— 这个高亮框只包住了 GLM-5V-Turbo 的分数。 “Multimodal Coding”和“Design2Code”其实是在左侧同一块区域。 我需要用更精确的布局重新构建一下。

目前唯一的问题就是核心数据列的外框没有很好的还原出来。

下面这个已经它的极限了:

然后我跑去它官网看了一下,好像确实有强调这是一个“原生多模态大模型”。

它的体验例子中,第一个就是图片理解:

然后,第二个例子我非常眼熟。

然后,第二个例子我非常眼熟。

这不就是我常常拿来测试的例子么?只是它把 5 米改成了 5.5 米。

糟糕🤣这个已经被优化训练了?看来,以后不能用这个测试题了!

总结一下:

通过粗略对比,目测 Qwen3.6 Plus 这个原生多模态能力还可以。 我的主观感受是比 GLM-5V 要好一些的! 在两次视觉类测试中,都可以非常清晰地看到,它会进行自主验证,这一点做的很好!

当然,也只是相对而言啦,不是说特别牛逼。

它的页面还原还是有不少细节问题,而且最后一个接口调用也没跑通。

要说自主验证和一次成功率,那还是得看 Opus 4.6! 如无意外,下一篇,我会详细介绍 Opus 4.6 的测试过程和结果。

另外,这几天我会把不同模型的测试结果进行汇总。

发布到: