所有Github Copilot用户请注意,事关隐私安全!

所有Github Copilot用户请注意,事关隐私安全!

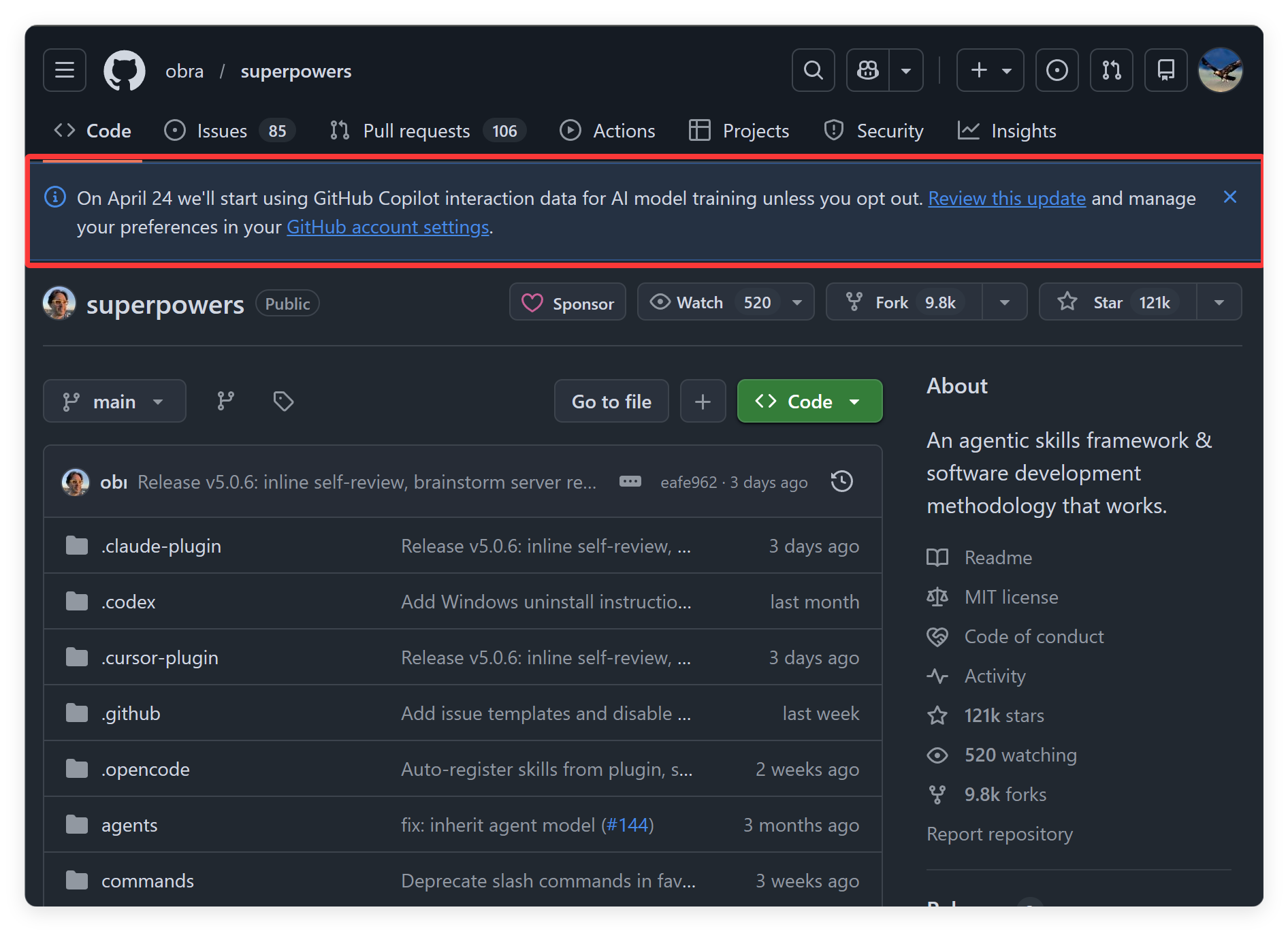

今天打开Github突然跳出一个提升:

对于这种提示,我们必须重视,否则你的经验被炼化成Token了你都不知道。

关键是,万一有隐私数据,内部代码,一旦被训练了,就无法剔除了。

所有使用Github Copilot的用户,应该花几分钟认真看一下Github这次的政策调整。

内容我已经整理好了!

核心变化

从 4 月 24 日起默认收集用户交互数据

从 2026 年 4 月 24 日起,针对 Copilot Free、Pro 和 Pro+ 用户,GitHub 将默认使用用户与 Copilot 的交互数据(包括输入、输出、代码片段及上下文)来训练和改进其 AI 模型。用户需主动选择退出(opt-out)才能不参与。

不受影响的用户: Copilot Business 和 Copilot Enterprise 用户不在此次调整范围之内。

哪些数据会被收集?

GitHub 明确列出了会收集的交互数据类型,包括:

- 你接受或修改的代码建议输出

- 发送给 Copilot 的输入内容(含代码片段)

- 光标位置周围的代码上下文

- 你编写的注释和文档

- 文件名、仓库结构和导航行为

- 与 Copilot 功能的交互(聊天、内联建议等)

- 你对建议的反馈(点赞/踩)

哪些数据不会被收集?

- Copilot Business、Enterprise 用户或企业仓库的数据

- 已选择退出模型训练的用户数据

- 静止状态(at rest)下的 issue、讨论内容及私有仓库内容——但文章特别强调,当你正在使用 Copilot 时,私有仓库的代码会被处理(作为运行服务所必需),这部分数据在你未退出的情况下可能用于模型训练。

数据会共享给谁?

数据可能共享给 GitHub 的关联公司(包括 Microsoft),但不会共享给第三方 AI 模型提供商或其他独立服务商。

为什么这么做?

GitHub 解释,早期模型主要依赖公开数据和手工代码样本。过去一年,他们已开始使用 微软员工的交互数据 进行训练,并观察到代码建议接受率等指标的显著提升。他们认为,来自真实开发者的交互数据是提升模型性能、让 Copilot 更智能的关键。

如何退出?

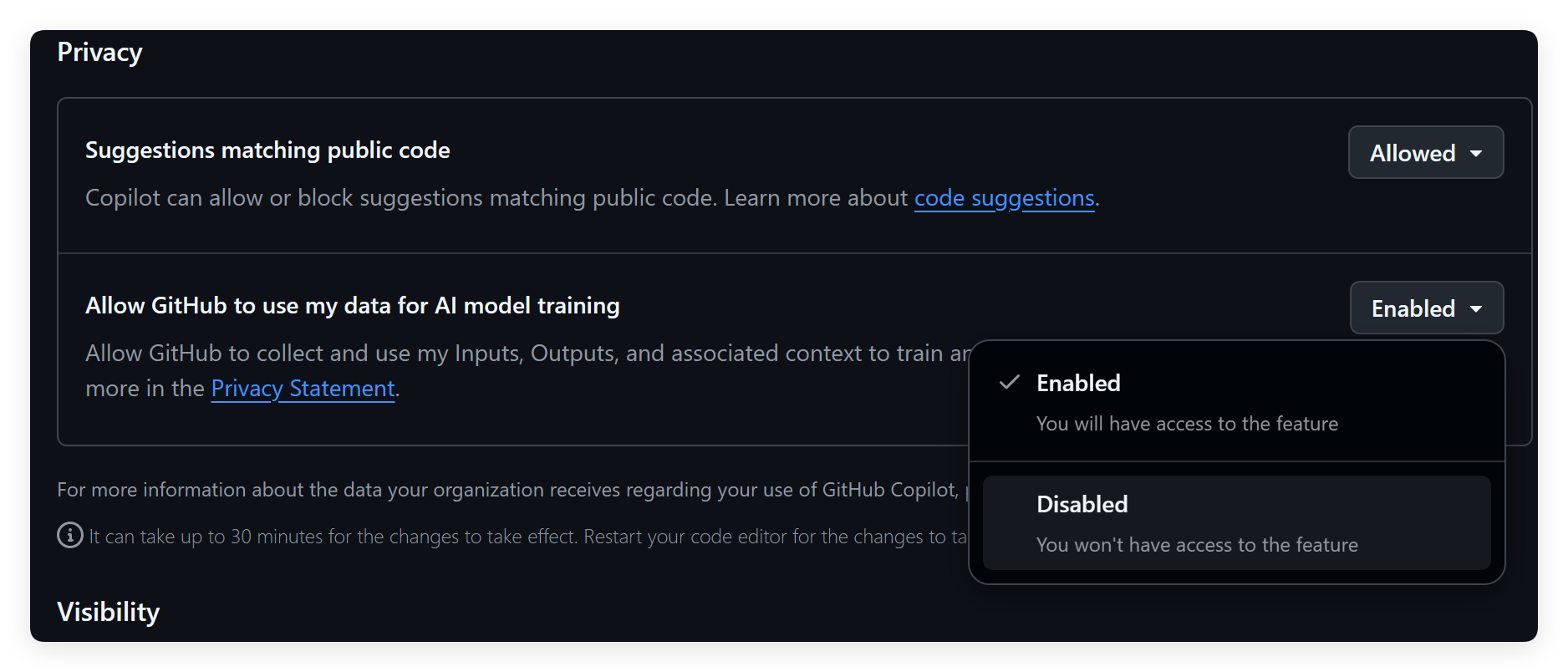

看了上面的内容,不知道大家作何感想。我是肯定选择关闭的。

具体的关闭路径是Github账号->Copilot设置->Privacy。

然后找到Allow GitHub to use my data for AI model training。

右侧选择Disabled。

总结与注意事项

这是一次典型的”默认开启、主动退出“政策变更,意味着如果你不主动操作,你的使用数据就会被用于 AI 训练。对于个人开发者(Free/Pro/Pro+),如果介意自己的代码或工作流被用于训练,应当尽快前往设置页面手动关闭。