MagicAnimate一键运行包,一张照片就能为所欲为了?

MagicAnimate 是啥我就不多介绍了,参考上一篇。

看这个动图,应该能心领神会了吧!

今天主要是来发一下软件包。

要玩转这个项目,抛开硬件不谈(怕劝退),软件上需要有两个部分构成。

一个是把一个模板视频转换这种紫色背景的驱动视频。

另一个是根据图片和驱动视频,生成最终的视频。

把视频变成驱动视频,就需要用到一个叫vid2densepose的开源项目。

而这个项目又用到了脸书(Meta)的对象检测,分割项目detectron2。

在具体一点就是要需要里面的DensePose!

这完美的演绎了,什么叫拔出萝卜带出泥。本来想搞个手枪,最后拖出了有一辆坦克。这个项目依赖太多了,烦人。

这里比较难搞的一点是,detectron2默认没有提供Windows版本!

vid2densepose 中提供了安装依赖的命令,但是一直编译失败。

另外,两个开源项目指定的torch版本也不一样,换来换去拉扯了好久,你行,我摆烂,我行你摆烂…

说这么多,主要是为了证明,我没有摆烂!

我努力了好久,才折腾出来的,记得多点赞,哈哈!

其实,这个软件包前几天就是发在知识星球了,因为时间紧迫,我没有说具体的用法。

今天就来介绍一下具体的用法,并且把软件包分享给大家。

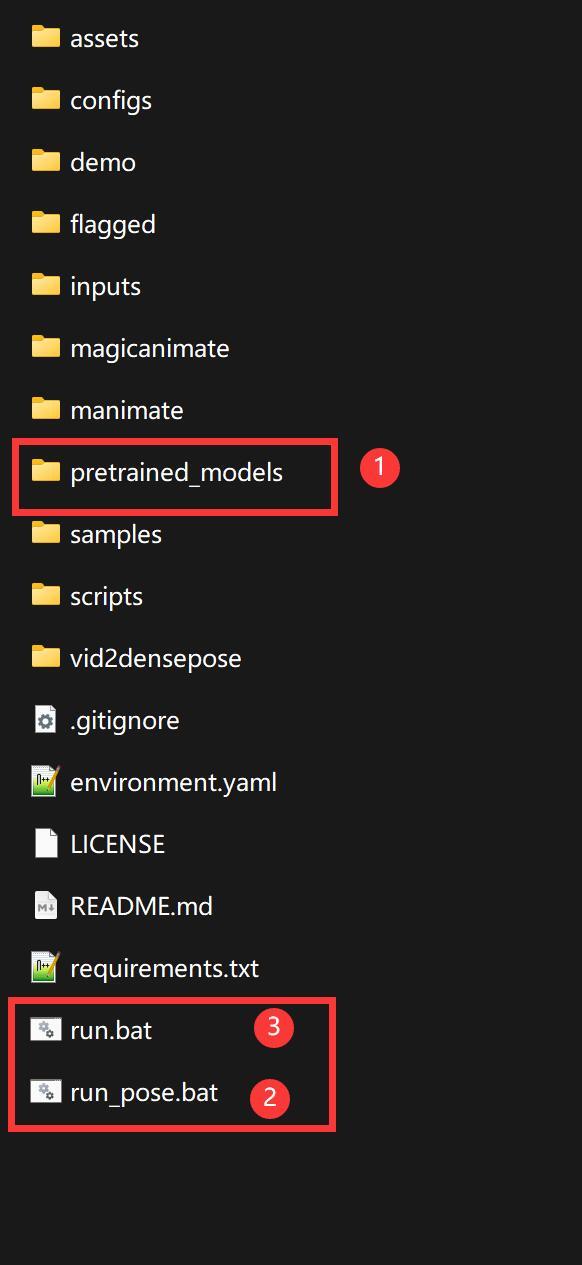

虽然背后的原理和配置挺复杂,但是到了操作层面就简单多了。只需要完成上面的三个步骤即可。

首先是获取软件并解压。

然后下载模型并放置到指定位置pretrained_models

然后是运行run_pose.bat 生成驱动视频。

然是运行run.bat生成最终视频。

软件和模型获取,见文末。

下载,解压,拷贝,这种没啥好说的。重点说一下②和③。

驱动视频生成

点击run_pose.bat 运行程序。

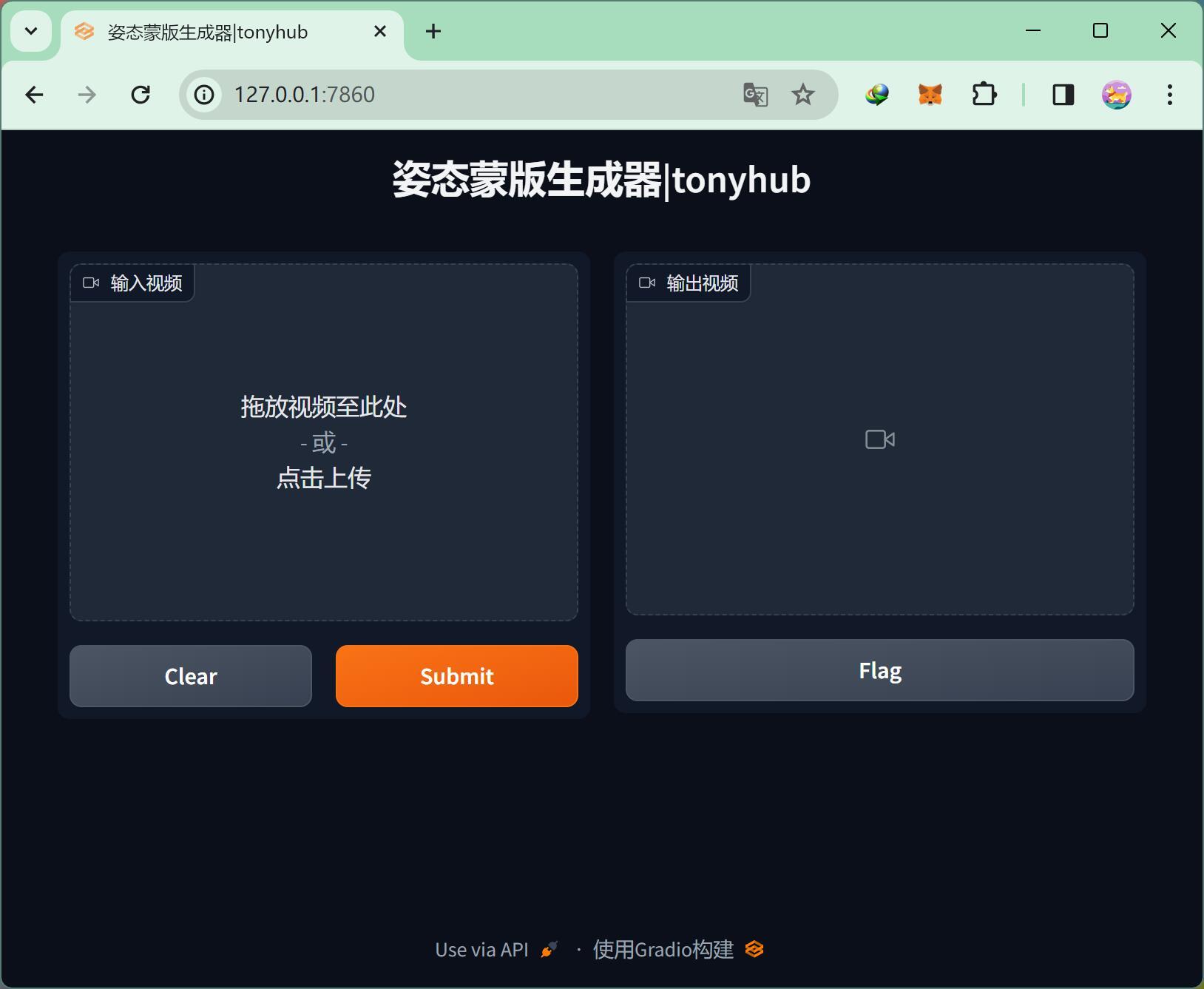

启动成功之后界面如下。

这里需要上传一个视频,就是上面说的模板视频,或者叫驱动视频。就是你想让某人做的某些动作。

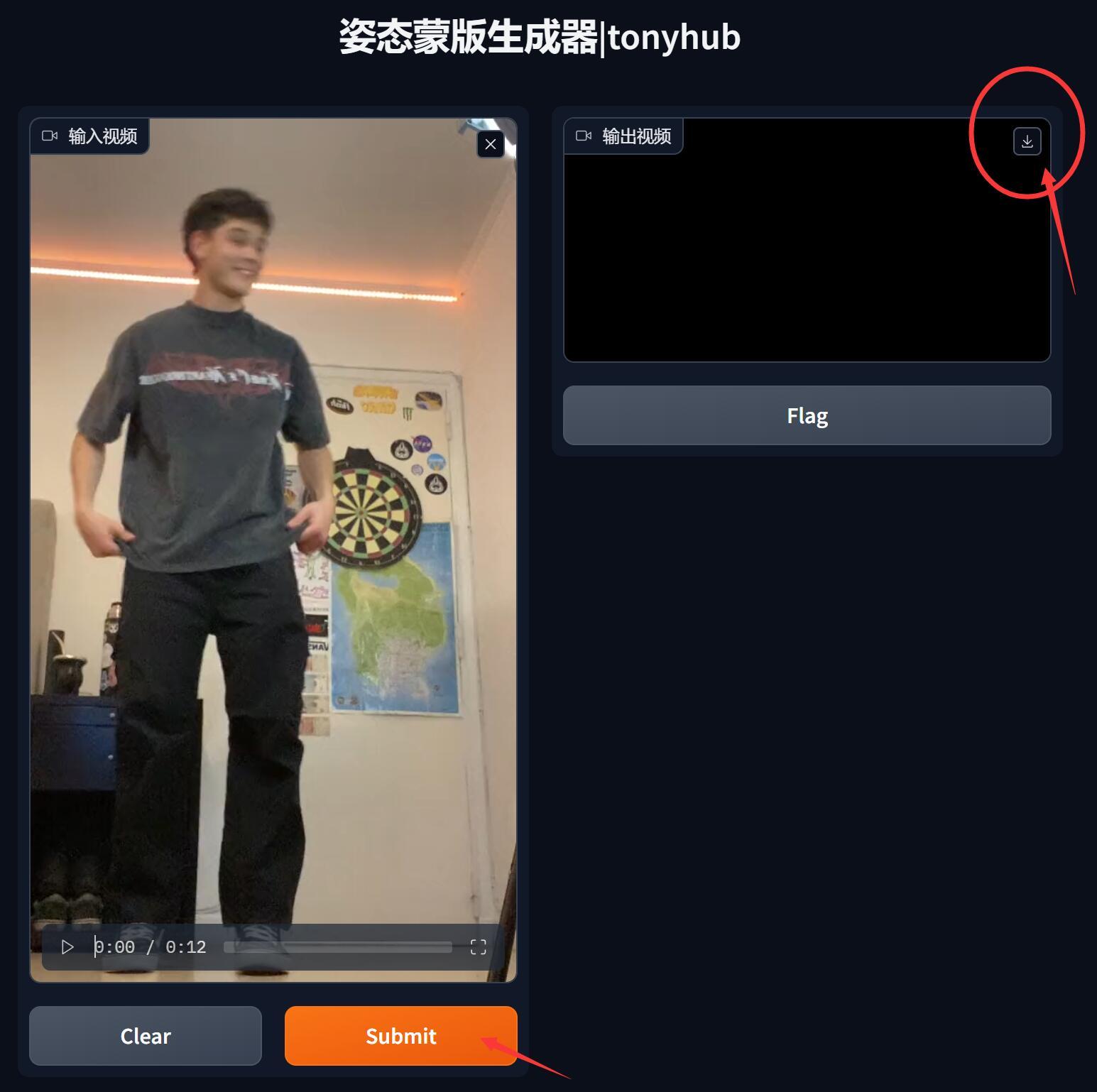

点击上传或者直接拖拽视频后,点击Submit按钮。

处理完成之后,右边就会出现一个新的视频,可以预览播放。可以点击右上角的图标下载到指定文件夹。

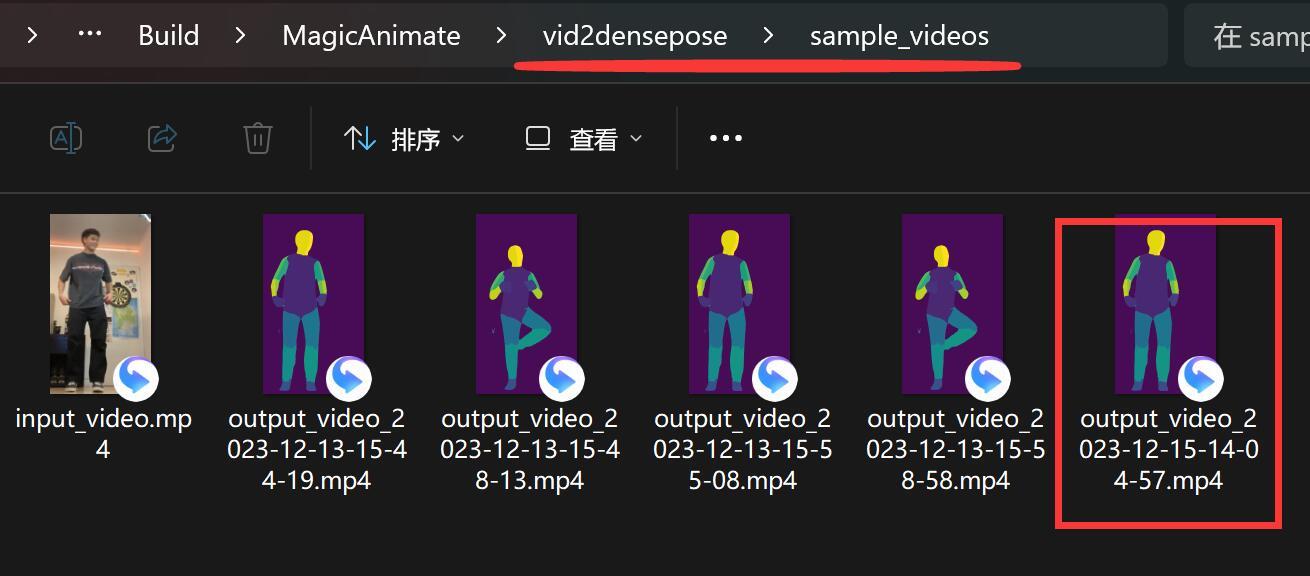

当然,即便你不下载,这个视频文件已经自动保存在文件夹里面了。路径见下图。

最终视频生成

有了驱动视频之后,我们就可以用这个驱动视频,去驱动一张图片,让它做出对应的动作了。

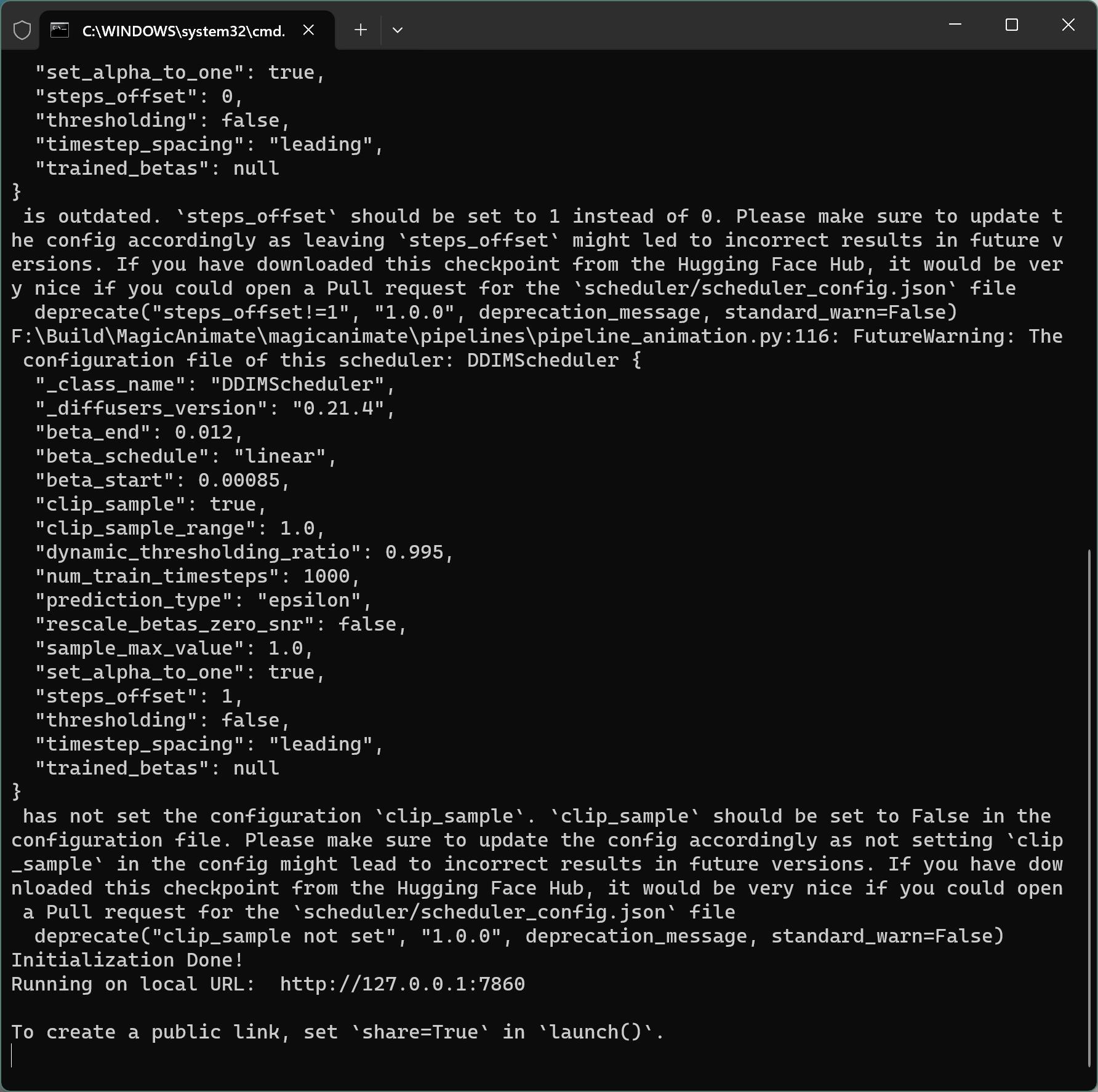

点击“run.bat” 启动主程序。启动过程需要加载很多模型,需要一些时间。

当看到Running on xxx 就证明启动成功了。

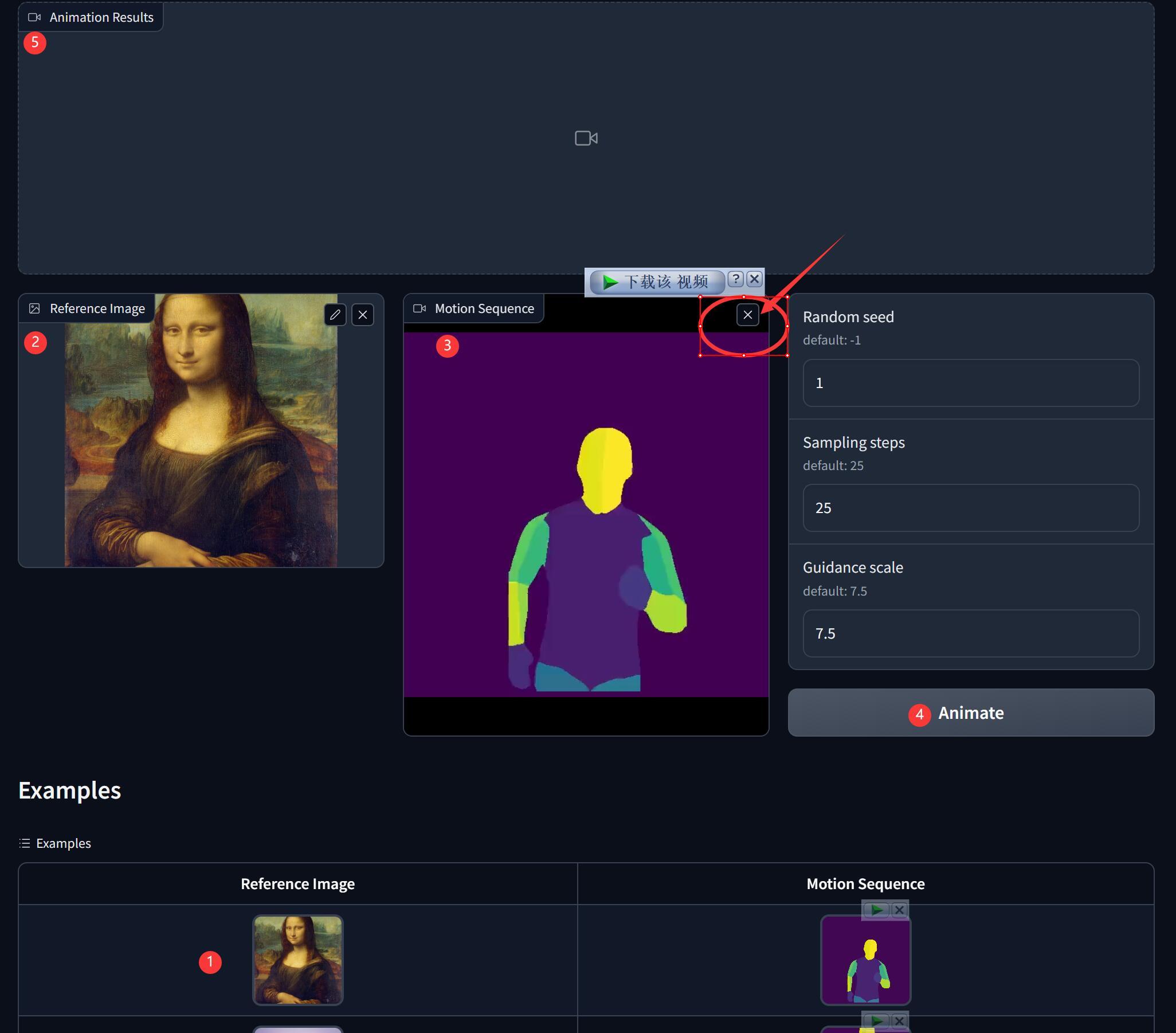

启动之后可以按如下步骤操作。

在之前的教程中,我们是直接使用了演示素材。只要点击Examples里面的某一行,就可以自动填充上面的内容。

因为这次我们自己生成了驱动视频,所以我们可以在③的地方上传自己的视频。

当然也可以在②的地方替换成其他图片。

设置好图片和驱动视频之后,就可以点击”Animate“按钮开始按钮制作视频了。

生成后的视频会显示在⑤的地方。

这个过程会需要一些时间,命令行窗口会有一个进度条。

几秒钟的视频,大概几分钟这个样子。

操作就是这些了!

如果电脑比较牛逼的话,就可以玩起来了。

软件获取方式,给公众号发送“magica” 即可!

另外,这个项目配置要求比较高,如果本地跑不起来,可以使用Colab云端脚本。

稍后我会把脚本放在TonyColab项目里面:

https://github.com/dream80/TonyColab