让白嫖的腾讯云DeepSeek快速联网!

我们在调用腾讯免费不限量的DeepSeekR1接口的时候,有聊到过一句他的“应用平台” 。

其中就有一个 DeepSeek联网助手。

有人说对这个很感兴趣,但是找不到入口,不知道怎么搞。

今天,我们就来说说这个。

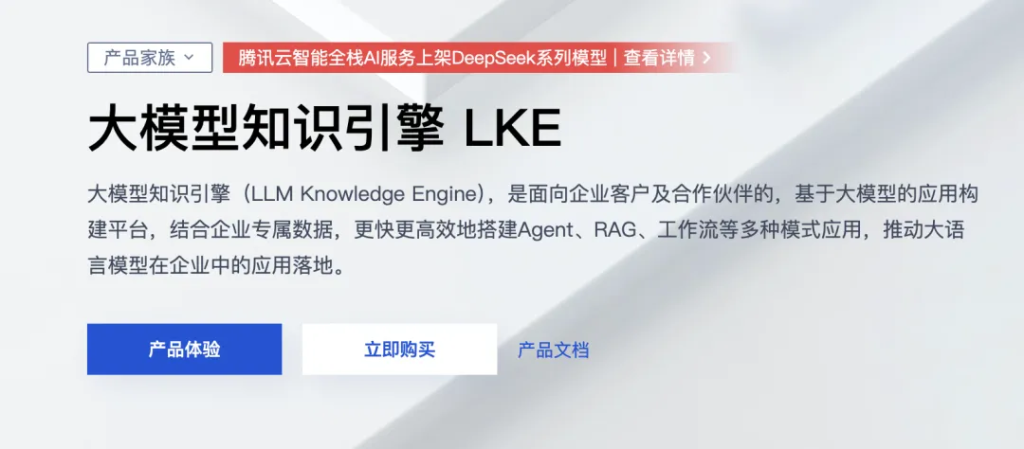

我们白嫖的腾讯云 DeepSeek 接口,属于腾讯大模型知识引擎 LKE产品线。

大模型知识引擎(LLM Knowledge Engine),是面向企业客户及合作伙伴的,基于大模型的应用构建平台,结合企业专属数据,更快更高效地搭建Agent(智能体)、RAG(检索增强生成)、工作流等多种模式应用,推动大语言模型在企业中的应用落地。

自己搞个 Agent,RAG,工作流,我想还是有很多人有兴趣的。既然白嫖了腾讯的API,就顺带研究一下。看看它这个应用,做到了什么程度,是否有实用性。

目前为公测阶段,可以 0 成本体验。

今天就来做个简单的基于 DeepSeek的联网搜索应用。核心操作就几步,非常简单,大部分基础工作都不需要我们来完成。

下面直接说操作。

1.注册并登录

如果是第一个次玩腾讯云,需要先登录并做一下个人认证。

登录网址:

https://cloud.tencent.com/login

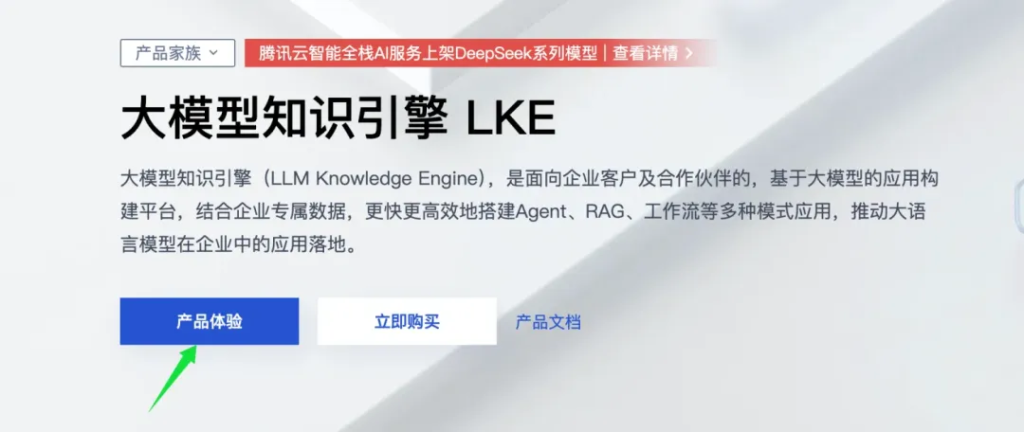

2.进入大模型知识引擎

这个入口可能不好找,网址:

https://cloud.tencent.com/product/lke

打开这个网址,然后点击产品体验。

3.创建应用

进入这个平台之后,有一个体验中心,可以快速体验一些大模型应用。

我们直接点应用管理,开始创建自己的搜索应用。

点击新建应用。

输入应用名称

这个名字没特殊要求,你想表达什么就写什么。只要能描述你的这个应用的功能就可以了。

4.切换模型

新建应用之后,就来到了应用配置界面。

这里我们只做两个设置,一个是切换成生成模型。

点击1️⃣处,弹出一个界面。在这个界面2️⃣处点开下拉菜单,选择 DeepSeek-R1。

5.启用搜索功能

另一个是启用搜索功能,也是我们这次的核心功能。

直接在界面上找到联网搜索,打开后面的开关就可以了。小手这么一点,搜索功能就有了。

除了这两个设置之外,可以简单地做一些个性化设置。比如设置应用的图标,设置一下欢迎语。

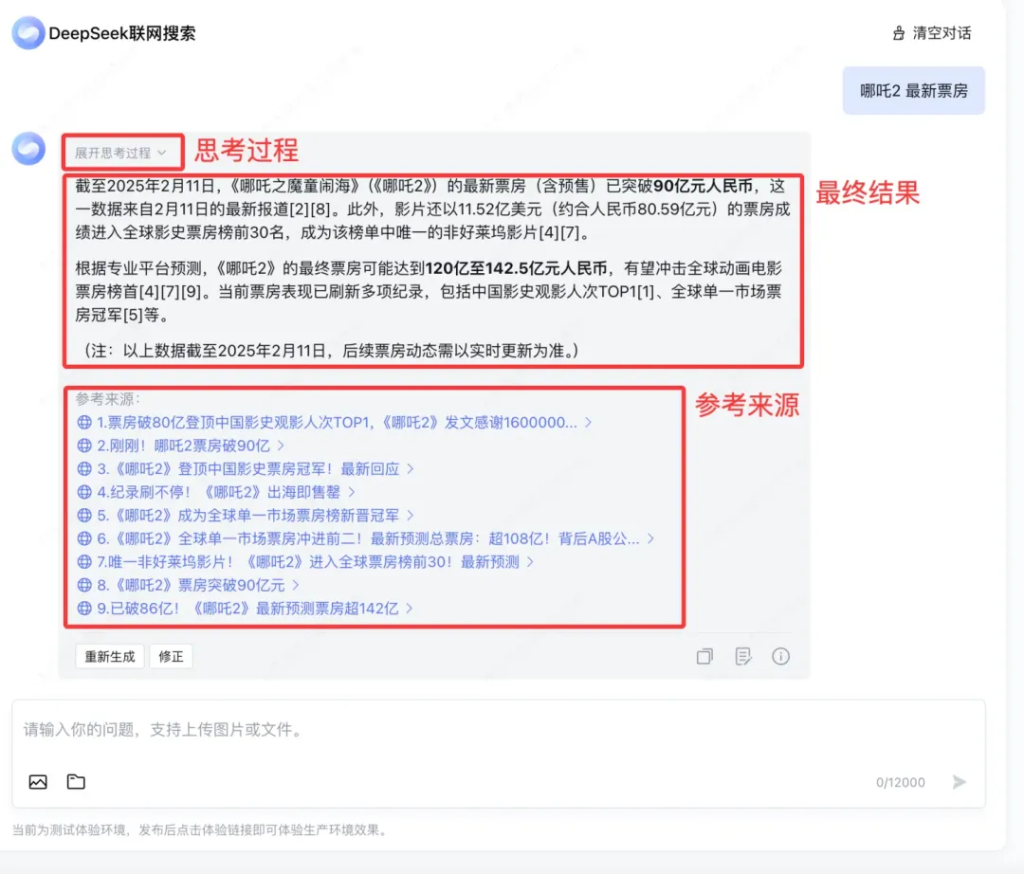

6 测试应用

设置完成之后,就直接可以在右侧的对话窗口进行测试了。

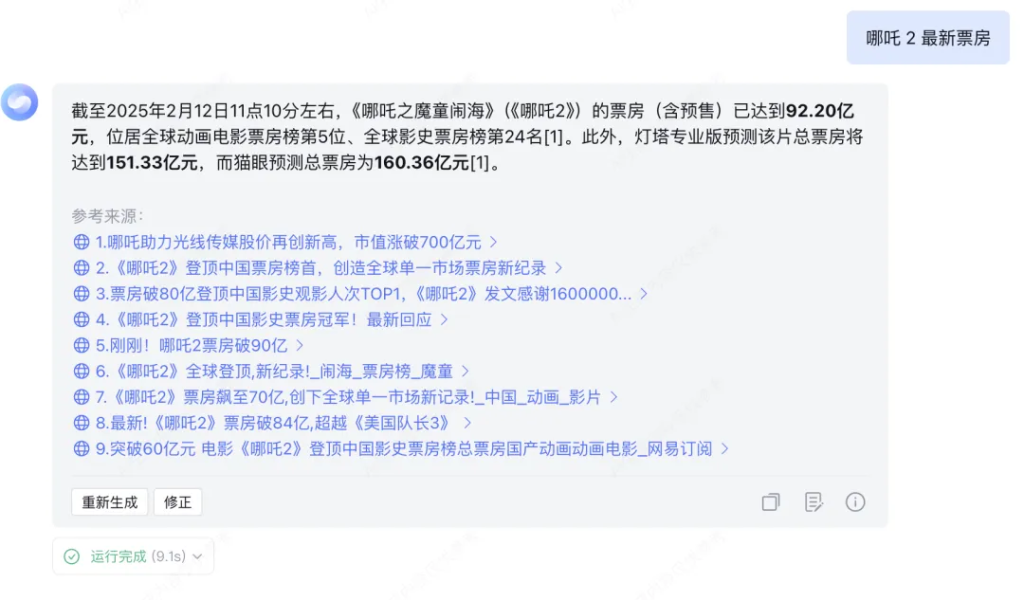

比如问一下“哪吒 2 最新票房?”

这很显然是一个需要联网才能回答的问题。

下面是实测的回答内容:

回答分成了三部分。

第一部分是思考过程

第二部分是思考结果

第三部分是参考来源

在思考之前,其实已经完成信息检索了,思考过程,主要是分析你的意图,从结果中抽取内容,进行整理和回复。

如果你比较追求速度,也可以把生成模型换成 DeepSeekV3。

然后再试一次同样的问题:

省去了思考过程,速度会快很多,结果也还不错。

推理模型R1 总共用了 40 多秒,V3整个过程 10 秒不到。

针对简单的检索问题,其实用 V3 就可以了,如果得到结果之后,还有复杂的分析推理,那么用 R1 比较好。

另外,这个测试窗口,也支持图片上传和文件上传。

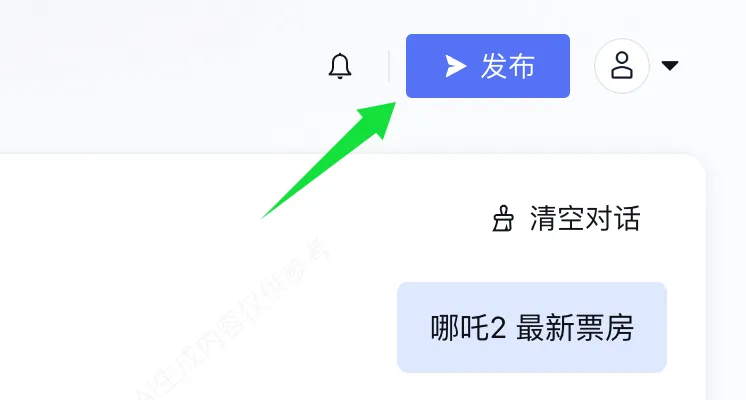

7.发布应用

测试完成之后,就可以发布应用了,点击右上角的发布功能。

添加发布说明

发布功能目前应该是自动生成,点击之后,很快就会通过。

发布成功之后可以在发布管理->调用信息中找到体验链接和 API信息。

8.后续操作

如果只是用着玩,可以直接复制上面的体验链接,开始使用,或者分享给别人使用。我测了一下,目前,上面的操作好像完全不消耗配额。

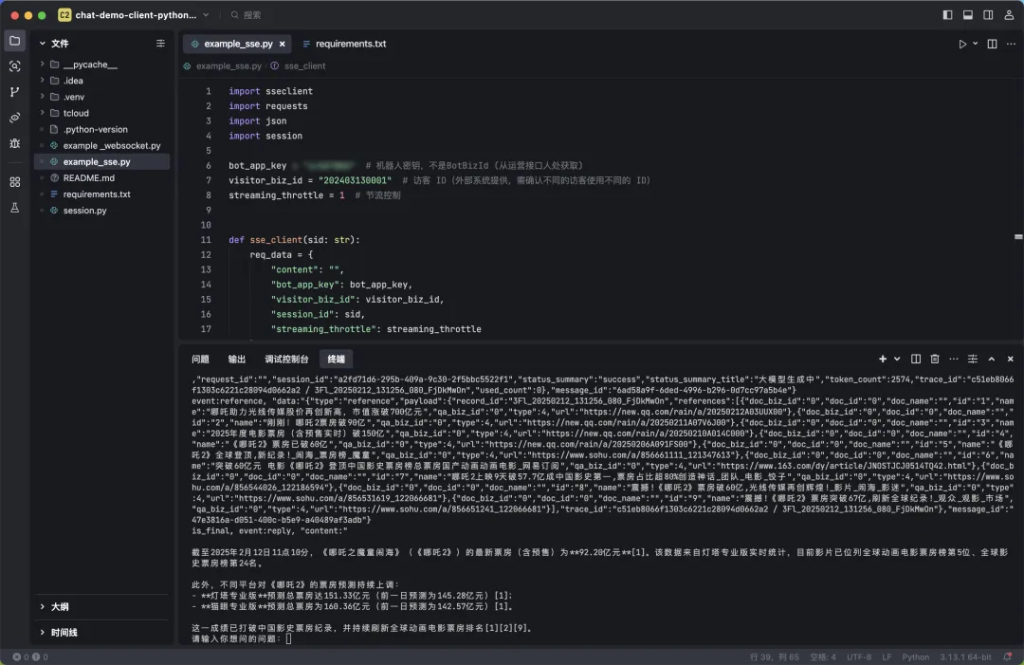

如果要把这个功能集成到自己的应用场景里面,就可以通过下面的接口信息,获取API 完成接口调用。可以做成桌面软件,也可以做成网站,手机APP 等。

根据官方提供的 demo 代码和文档很容易就可以调通。

只要修改一个 bot_app_key,

创建一个虚拟环境tengxun,

安装一下 requirements.txt中的依赖文件,

运行命令:python example_sse.py

然后输入你的问题,等待回应就好了。

最后叫 DeepSeek或者基于AI的IDE,帮你开发一个界面,齐活了。

扩展内容

如果你关注点在强大的搜索功能,那么可以尝试一下两个专业的AI搜索工具。

他们都集成了 DeepSeek R1。

一个是国内的秘塔 AI 搜索:

启用一下长思考·R1!

另外一个是国外的perplexity搜索:

点击 Auto 选择 Reasoning with R1 ,然后再进行搜索。

DeepSeeK R1 搜索相关的内容就讲到这里了,接下来可能会尝试一下,RAG(检索增强生成),就是创建自己的知识库,并快速精准的检索内容。