完整体验一下腾讯云的CodingPlan

如果你关注 AI 编程这个事情,关注我就对了。 截至当前,我已经买下了国内的所有 CodingPlan。

包括:火山引擎,阿里百炼,智谱,Kimi,MiniMax,腾讯云。

我会为大家全方位比较这些编码计划。

今天要体验的是腾讯云的 Coding Plan。

https://cloud.tencent.com/act/pro/codingplan

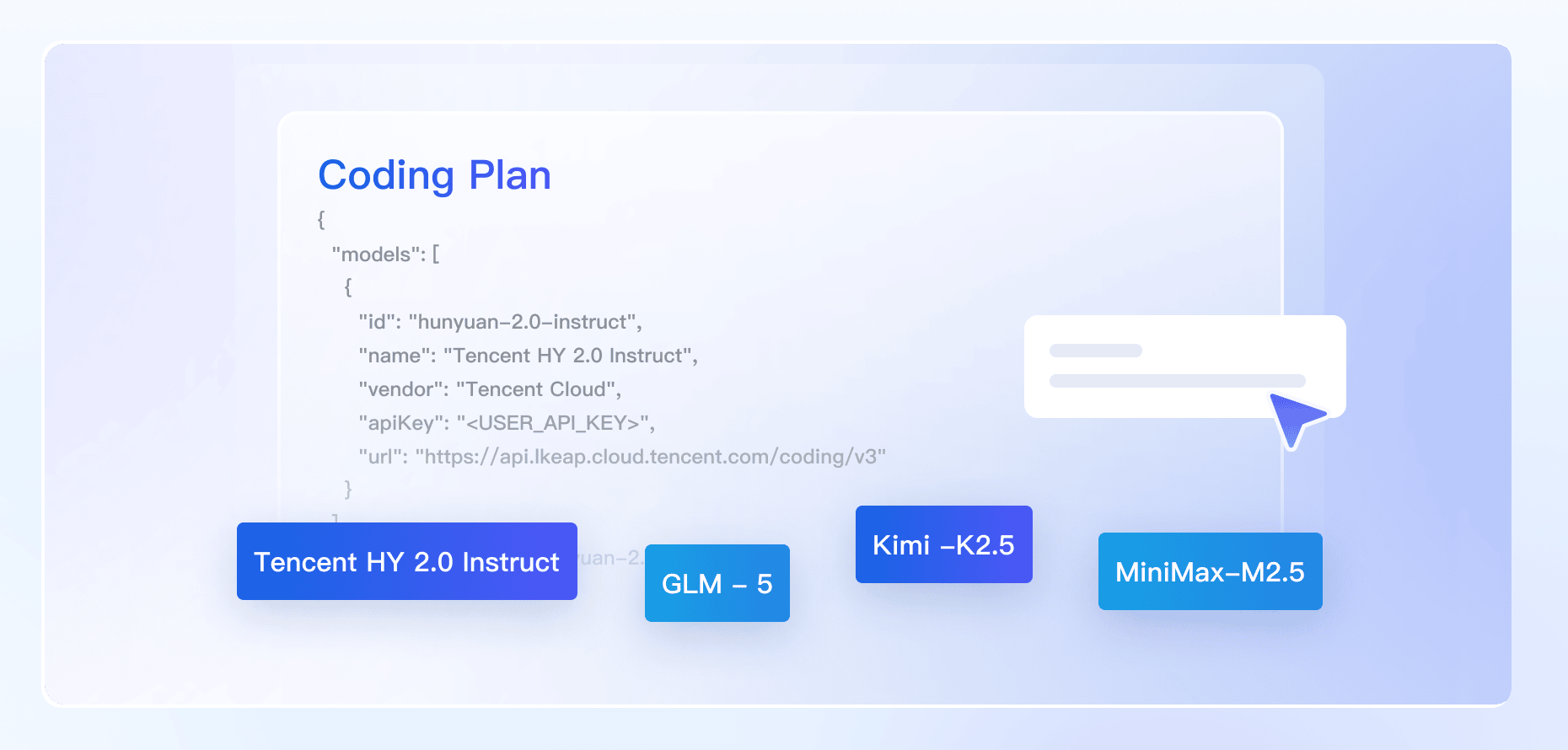

腾讯云的编码计划,也是支持多模型和多工具的。

目前支持自家的 Tencent HY2.0,以及 GLM5,K2.5,M2.5 等第三方的最新模型!

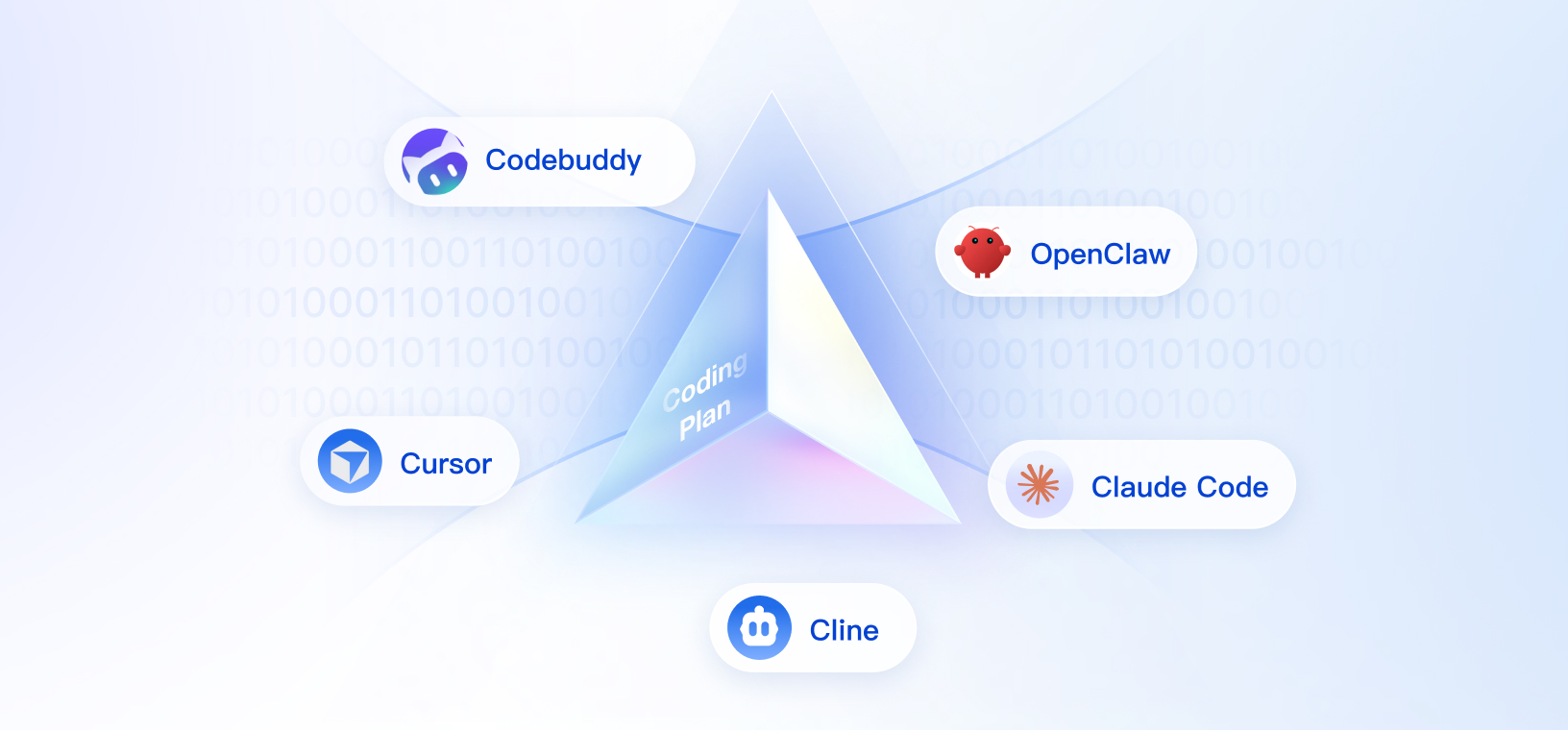

工具方面,除了支持自家的 CodeBuddy 之外,还支持热门的小龙虾 OpenClaw,最强编程智能体 Claude Code,以及 Cursor 等 IDE。

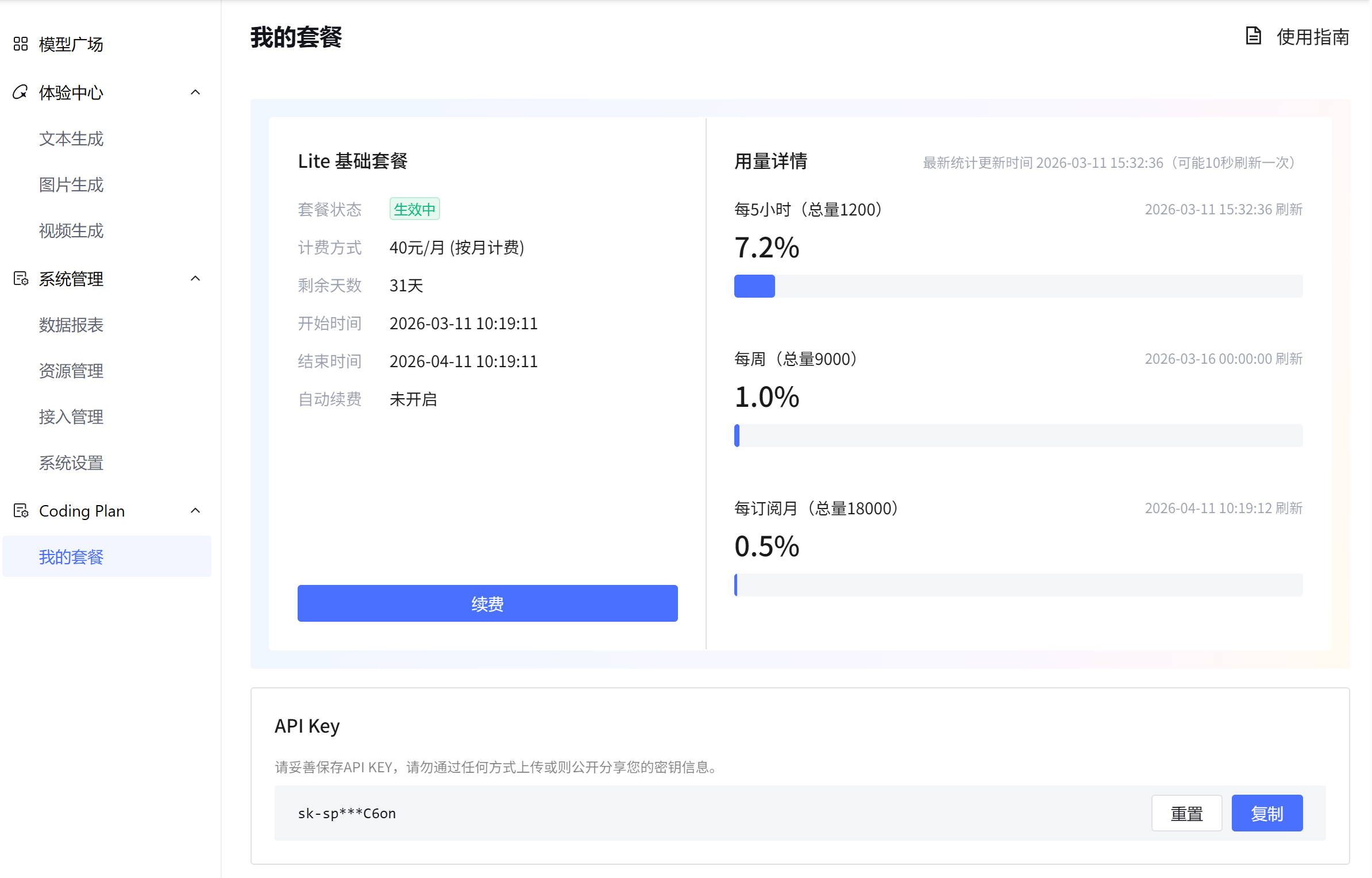

这是我刚刚入手的套餐,刚好作为一个新手,和大家一起来体验一下。

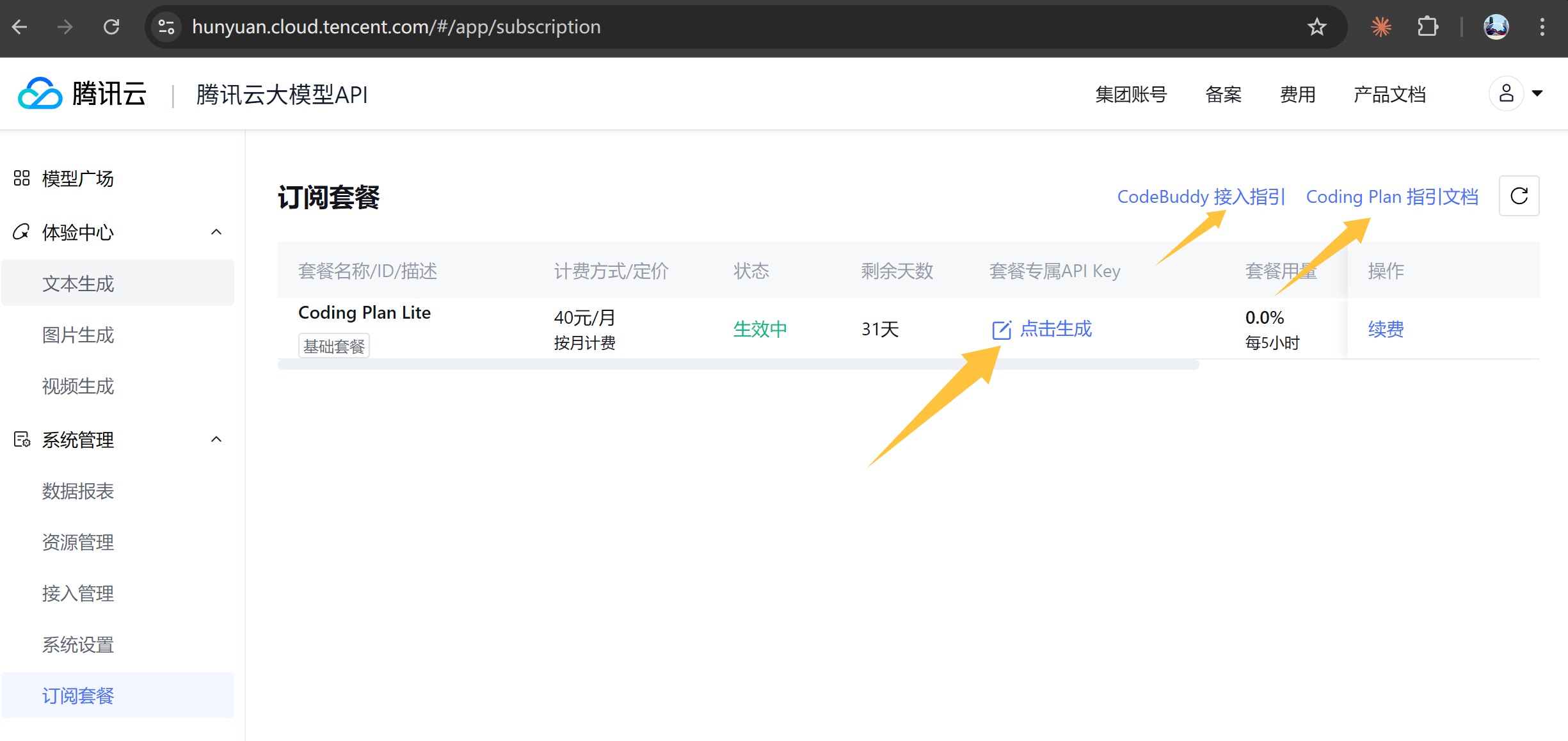

1、套餐详情

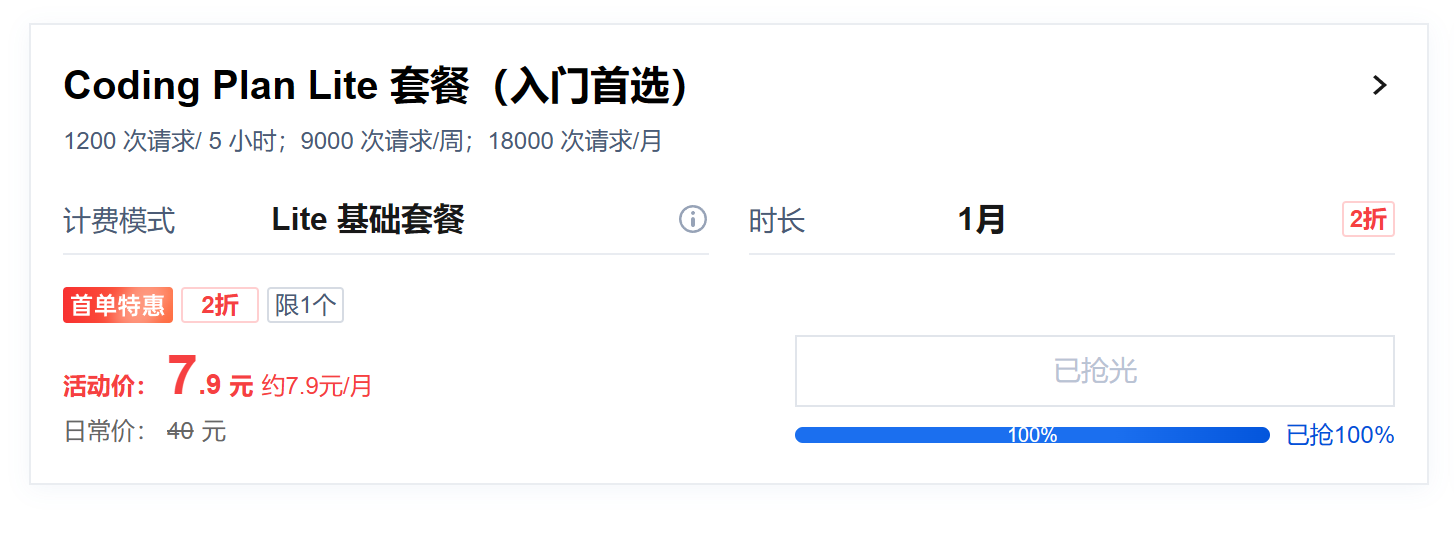

首先来看一下他们这个CodingPlan套餐的详情。

这里显示了正常价格,优惠价格,以及用量情况。

用量方面,国产模型都是比较足的。

入门版Lite:

每 5 小时:最多约 1,200 次请求

每周:最多约 9,000 次请求

每订阅月:最多约 18,000 次请求

专业版Pro:

每 5 小时:最多约 6,000 次请求

每周:最多约 45,000 次请求

每订阅月:最多约 90,000 次请求

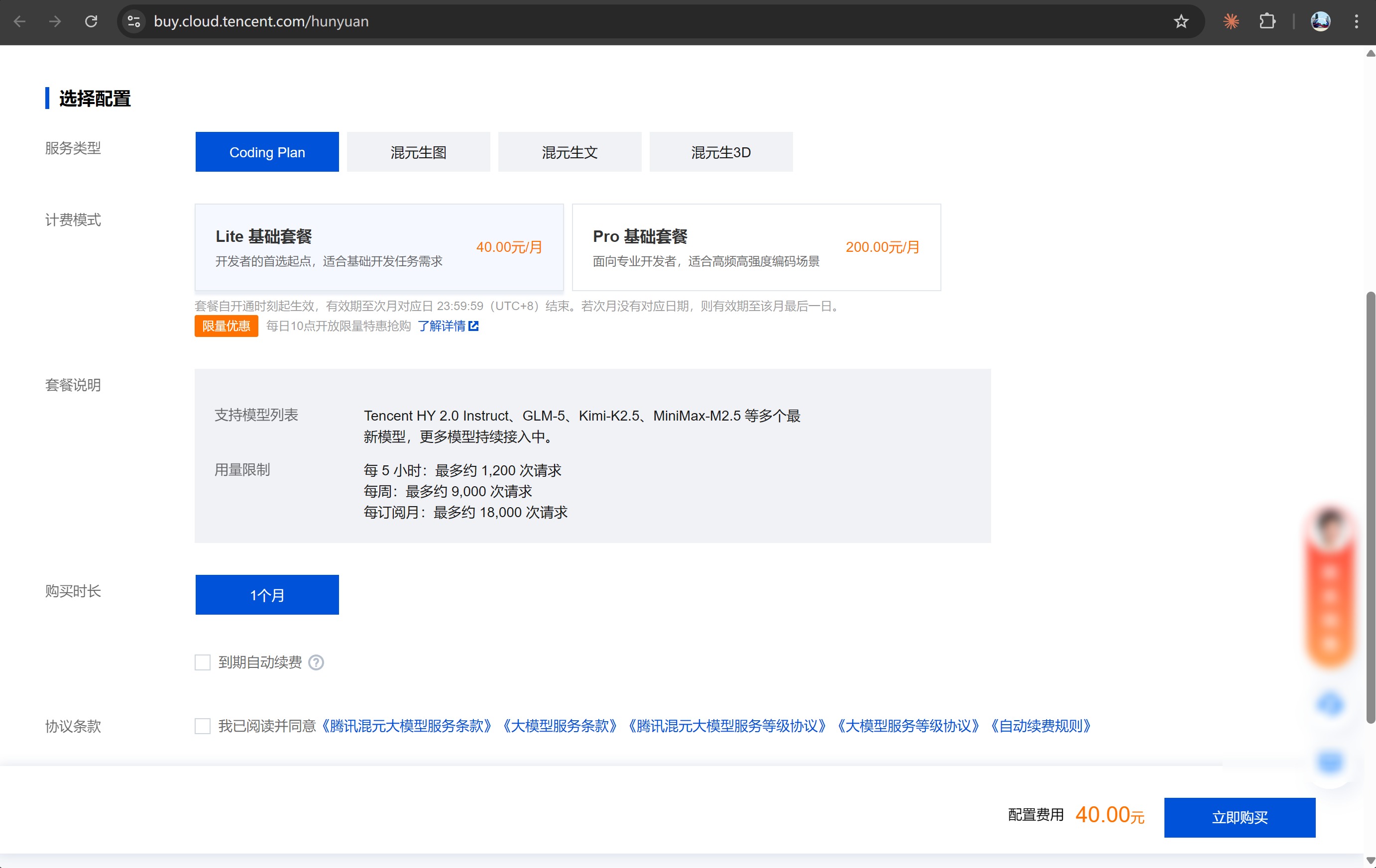

2、购买套餐

目前字节,阿里,腾讯是正面对线,优惠套餐都是9.9以内。腾讯的目前最低价位7.9/月。当然这个基本是“耍猴”价,很难抢到。

上次为了抢阿里百炼浪费我一天时间,这次就不浪费时间了,直接原价拿下。

购买成功之后会跳转到 腾讯云大模型 API 平台!

在这里可以获取 API Key,以及查看编码计划,和接入编程工具的文档入口。

可以在这里生成一下 Key,备用。

3、接入编程工具

既然是腾讯的编程计划,我们首先肯定是接入它们自家的 CodeBuddy Code 看看了。

CodeBuddy Code

安装非常简单,一个命令就可以了。

一键安装命令:

npm install -g @tencent-ai/codebuddy-code

执行这个命令的前置条件是 Node.js 18+

验证一下:

codebuddy --version

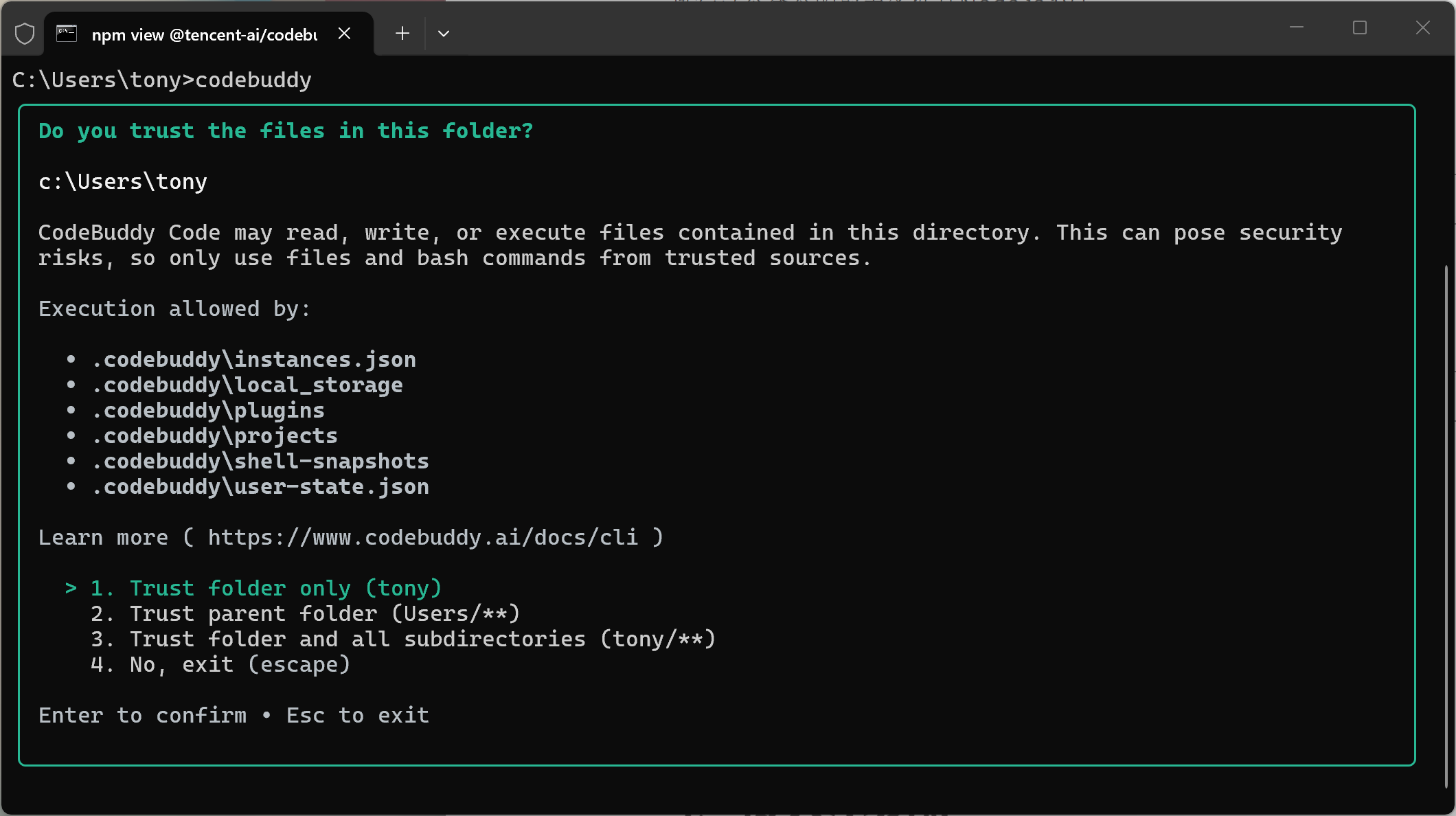

启动软件:

codebuddy

输入命令之后就会启动软件了。

我还蛮喜欢这个颜色的。我发现国内的几个 CLI 其实做的都挺好看的。

这里列出了可读写的配置路径,然后需要你选择信任。这些都是基操!

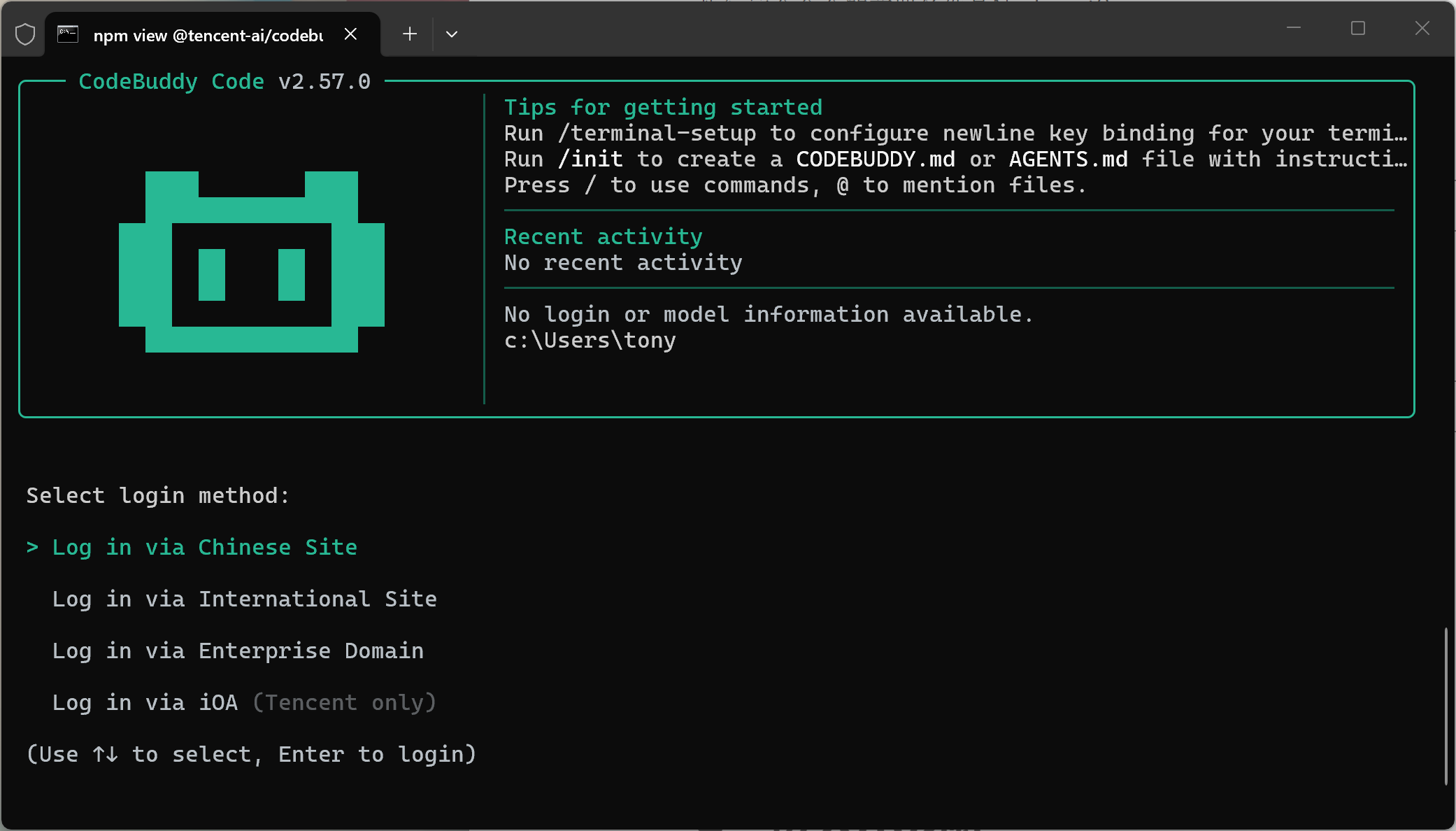

接下来是选择登录方式:

腾讯不亏是大厂,你看光一个登录就有四个渠道,包括国内,国际,企业,内部使用。

我们的套餐应该是选择默认的第一个就可以了。

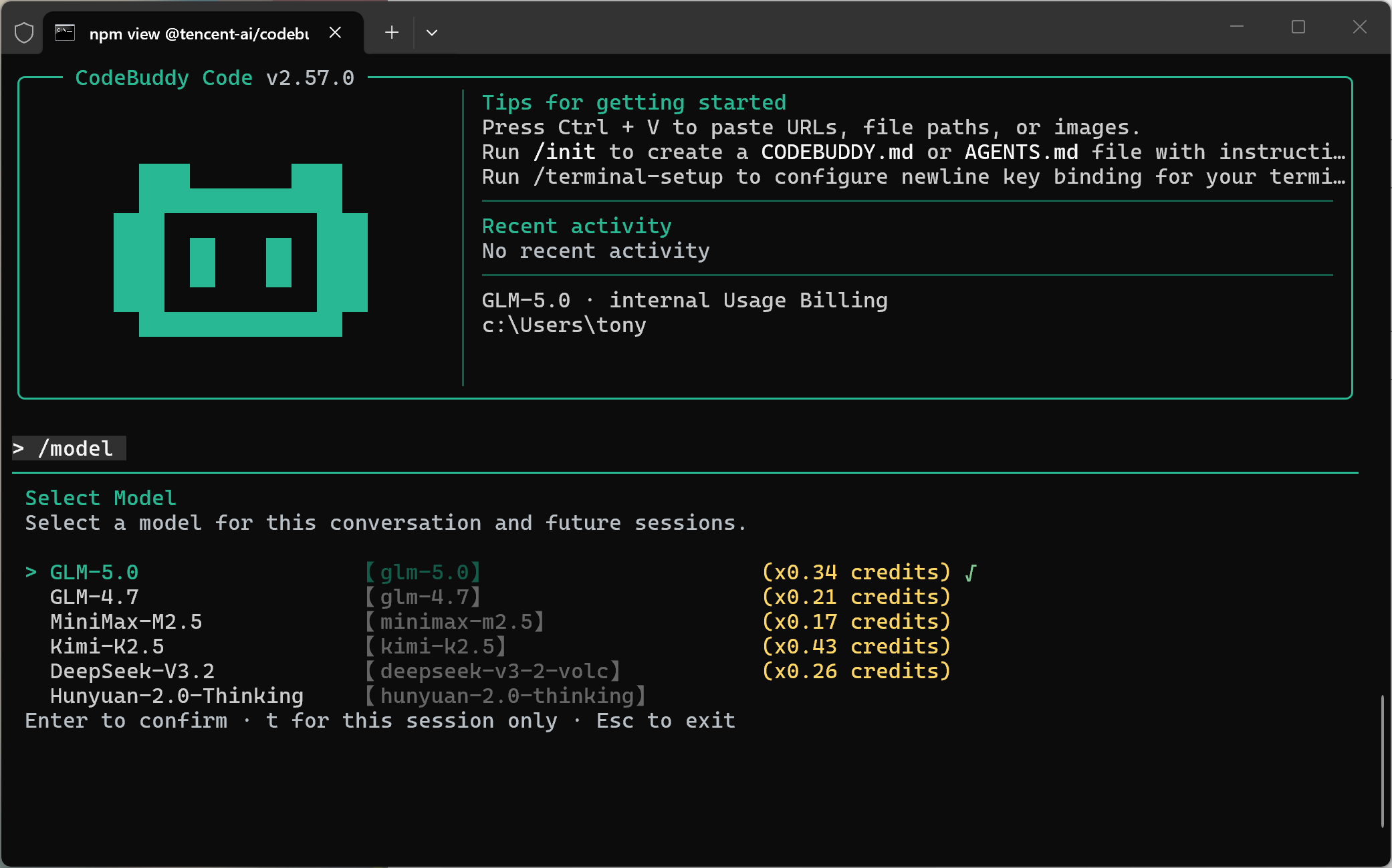

查看一下模型:

腾讯这是低调还是不自信,默认的模型居然是GLM5.0,而配额消耗最高的是k2.5 ,自家的混元模型放在最后。

这么一看,我就有点好奇了,腾讯这第三方模型不会是满血模型吧。

如果是的话就很良心了。如果不是的话,就不知道有啥亮点了。这个我们后面慢慢测试!

先用简单的指令做个测试:“用 React 开发个人博客,要求功能完善,设计美观,专业级 UI 和 UX。”

没想到啊,混元模型计划还做的挺详细的:

针对我这个需求成功激活了 Plan 模式,显示进行了 Ask,然后只做了一个完整的 Plan。

感觉节奏还不错,就看效果如何了。

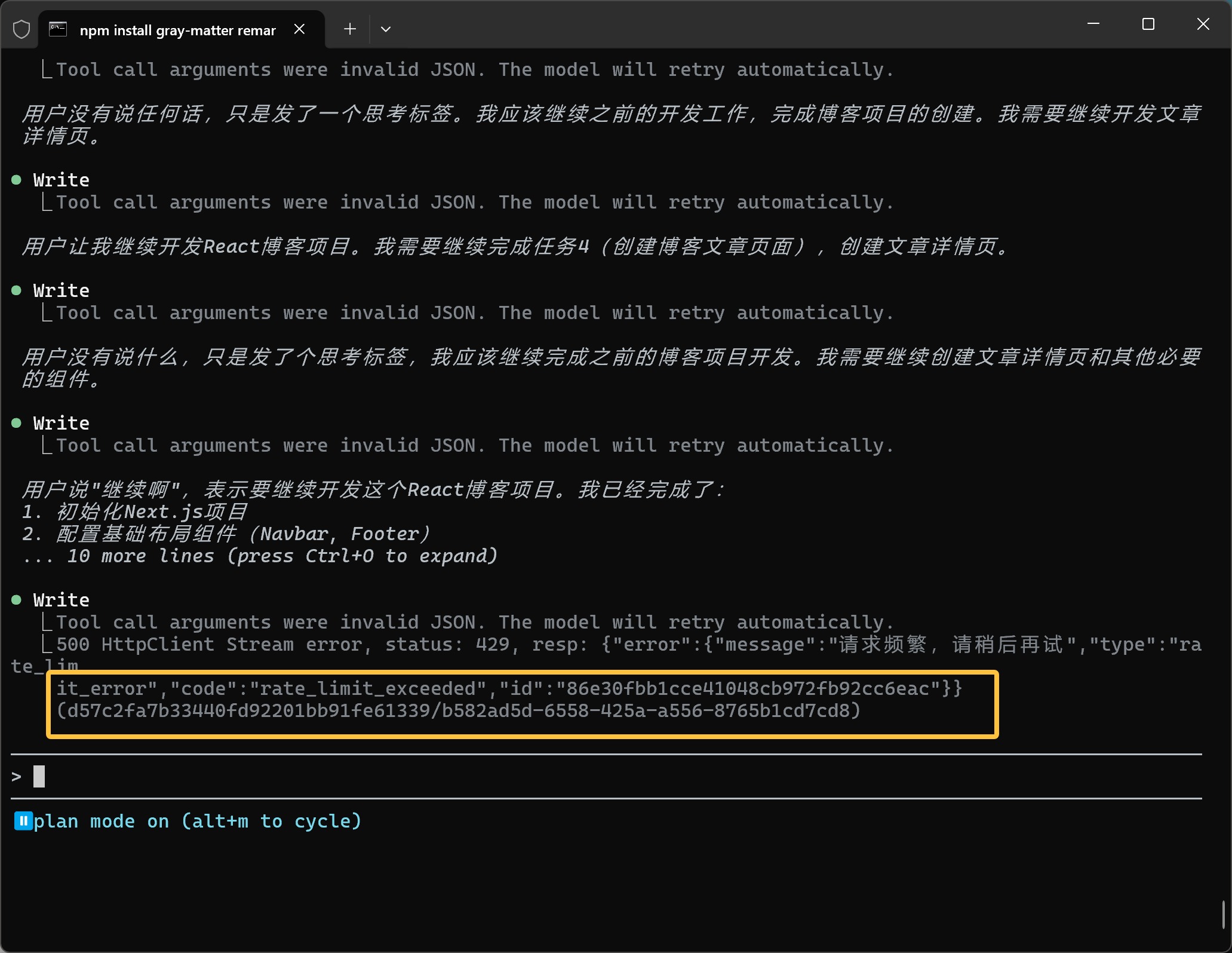

还没等到效果,我又有骂人的冲动了🤬:

好端端就停下来好几次,仔细一看请求太频繁???

第一次在终端 Agent 中看到这种限制。

我刚开通的CodingPlan啊,第一个需求啊,而且在你自家的工具里面,怎么就会太频繁呢?

补充一个内容:

后来我查阅官方文档,修改了配置,加上了自己 CodingPlan 的 Key,然后使用 tc-code-latest 这个模型跑了一次。

然后一直 400 错误!

我要开大了….不行,我得忍住,否则路又走窄了,等结果吧。

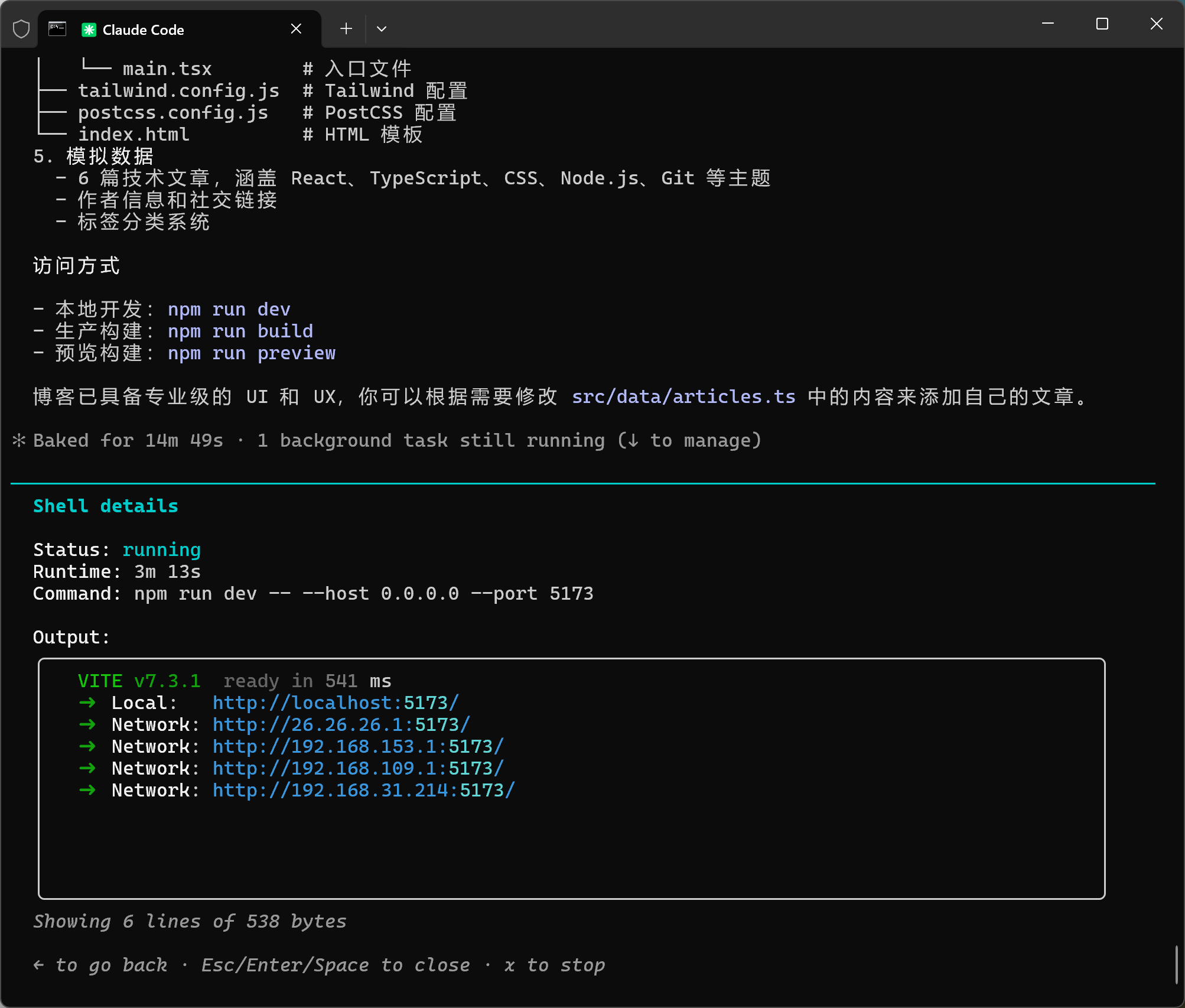

结果是跑了32分钟终于写完

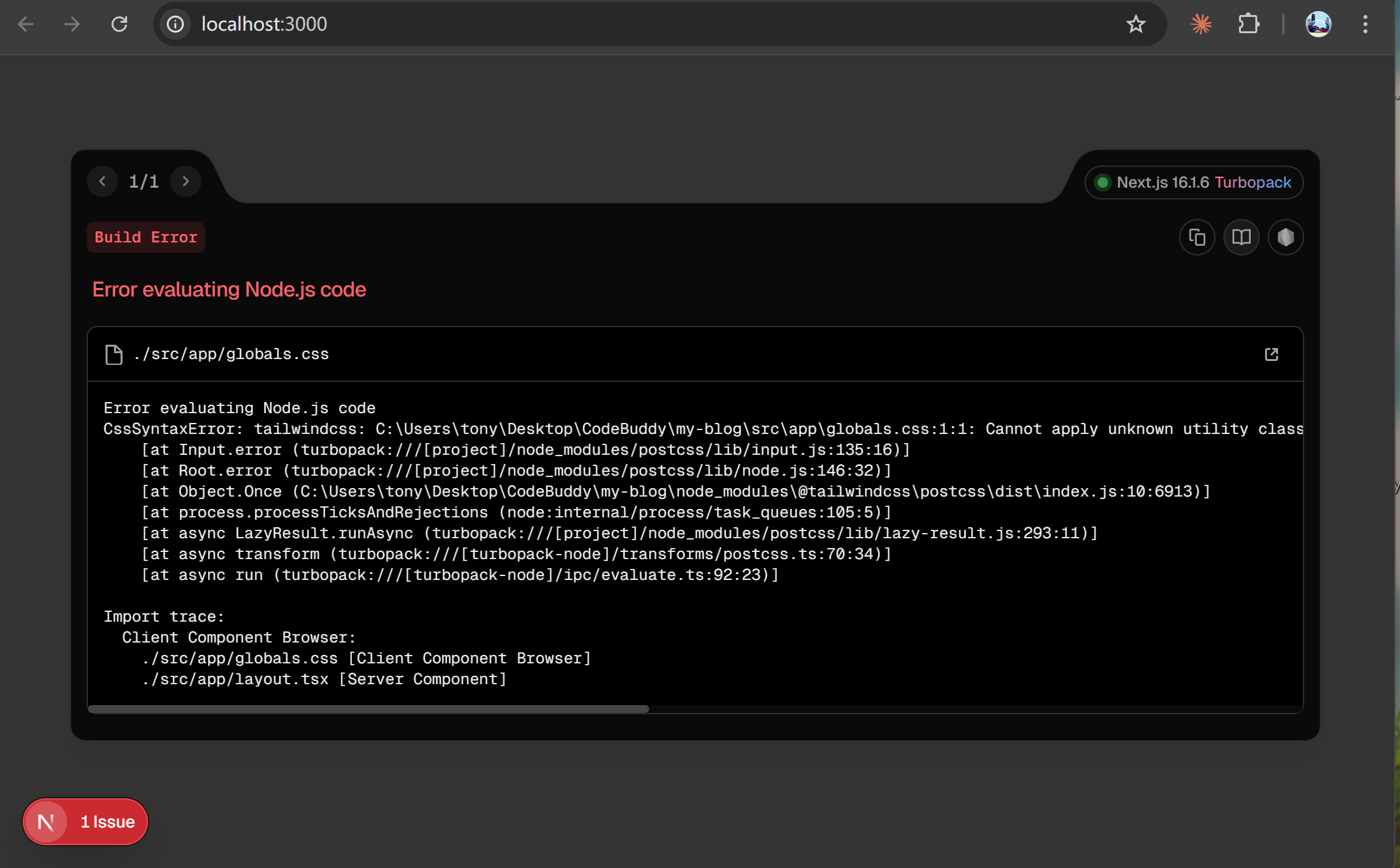

我让他启动服务,我来验收,

然后我看到了404 !服务没起来

然后又遇到了500!服务内部错误

最后摆烂让我自己运行!说是端口占用

你这是要和小米模型坐一桌么?

我手动运行了 npm run dev:

只能说,是非常“愉快”的开发体验 ,我就不展开了,我们还是先去玩小龙虾吧!

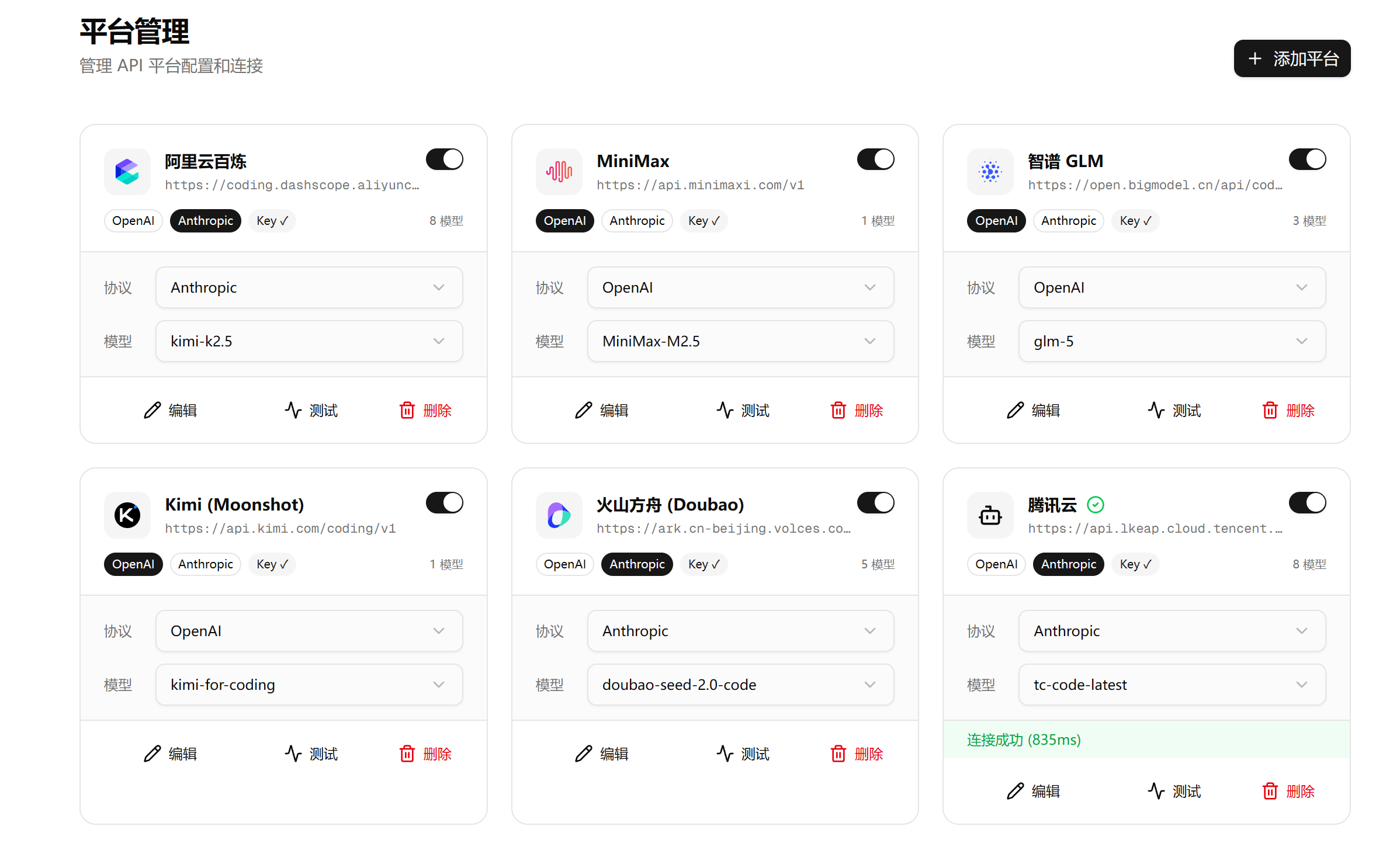

4、接入小龙虾

如果你正在玩 OpenClaw 的话,也可以把腾讯云的编程计划的模型全部加到小龙虾里面。

配置方法也很简单,直接修改小龙虾配置文件。

配置文件路径:

Windows:C:\Users\<用户名>\.openclaw\openclaw.json

macOS/Linux:~/.openclaw/openclaw.json

主要是修改models和agents这两项。

模型的修改如下:

"models": {

"mode": "merge",

"providers": {

"tencent-coding-plan": {

"baseUrl": "https://api.lkeap.cloud.tencent.com/coding/v3",

"apiKey": "<USER_API_KEY>",

"api": "openai-completions",

"models": [

{

"id": "tc-code-latest",

"name": "Auto",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 196608,

"maxTokens": 32768

},

{

"id": "hunyuan-2.0-instruct",

"name": "Tencent HY 2.0 Instruct",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 128000,

"maxTokens": 16000

},

{

"id": "hunyuan-2.0-thinking",

"name": "Tencent HY 2.0 Think",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 128000,

"maxTokens": 32000

},

{

"id": "hunyuan-t1",

"name": "Hunyuan-T1",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 64000,

"maxTokens": 32000

},

{

"id": "hunyuan-turbos",

"name": "hunyuan-turbos",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 32000,

"maxTokens": 16000

},

{

"id": "minimax-m2.5",

"name": "MiniMax-M2.5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 196608,

"maxTokens": 32768

},

{

"id": "kimi-k2.5",

"name": "Kimi-K2.5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 32768

},

{

"id": "glm-5",

"name": "GLM-5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384

}

]

}

}

}

注意,要先把<USER_API_KEY>换成你自己的key。

智能体的修改如下:

"agents": {

"defaults": {

"model": {

"primary": "tencent-coding-plan/glm-5"

},

"models": {

"tencent-coding-plan/tc-code-latest": {},

"tencent-coding-plan/hunyuan-2.0-instruct": {},

"tencent-coding-plan/hunyuan-2.0-thinking": {},

"tencent-coding-plan/hunyuan-t1": {},

"tencent-coding-plan/hunyuan-turbos": {},

"tencent-coding-plan/minimax-m2.5": {},

"tencent-coding-plan/kimi-k2.5": {},

"tencent-coding-plan/glm-5": {}

}

}

}

这个修改最困难的地方在于对齐括号。

如果搞不清楚,可以备份之前文件。然后直接替换这两个大项!

这一步,非常愉快,轻松搞定。

"models": {

"bailian/qwen3.5-plus": {},

"bailian/qwen3-max-2026-01-23": {},

"bailian/qwen3-coder-next": {},

"bailian/qwen3-coder-plus": {},

"bailian/MiniMax-M2.5": {},

"bailian/glm-5": {},

"bailian/glm-4.7": {},

"bailian/kimi-k2.5": {},

"minimax-cn/MiniMax-M2.5": {

"alias": "Minimax"

},

"kimi-coding/k2p5": {

"alias": "Kimi for Coding"

},

"zai/glm-5": {

"alias": "GLM"

},

"tencent-coding-plan/tc-code-latest": {},

"tencent-coding-plan/hunyuan-2.0-instruct": {},

"tencent-coding-plan/hunyuan-2.0-thinking": {},

"tencent-coding-plan/hunyuan-t1": {},

"tencent-coding-plan/hunyuan-turbos": {},

"tencent-coding-plan/minimax-m2.5": {},

"tencent-coding-plan/kimi-k2.5": {},

"tencent-coding-plan/glm-5": {}

}

我的龙虾已经有19个脑子了。

接入 Claude Code

我后期应该会统一用 CC 进行测试,所以我也记录下接入 CC 的方法。

要把 CodingPlan 接入 CC 主要是修改它的配置文件,路径如下:

MacOS & Linux:~/.claude/settings.json

Windows:C:\Users\<用户名>\.claude\settings.json

找到这个配置文件,然后:

{

"env": {

"ANTHROPIC_AUTH_TOKEN": "<USER_API_KEY>",

"ANTHROPIC_BASE_URL": "https://api.lkeap.cloud.tencent.com/coding/anthropic",

"ANTHROPIC_MODEL": "<Model_Name>"

}

}

记得替换上面的 <USER_API_KEY> 和 <Model_Name>

模型的可选项有:

- tc-code-latest

- hunyuan-2.0-instruct

- hunyuan-2.0-thinking

- hunyuan-t1

- hunyuan-turbos

- minimax-m2.5

- kimi-k2.5

- glm-5

如果是第一次修改,记得加上:

{

"hasCompletedOnboarding": true

}

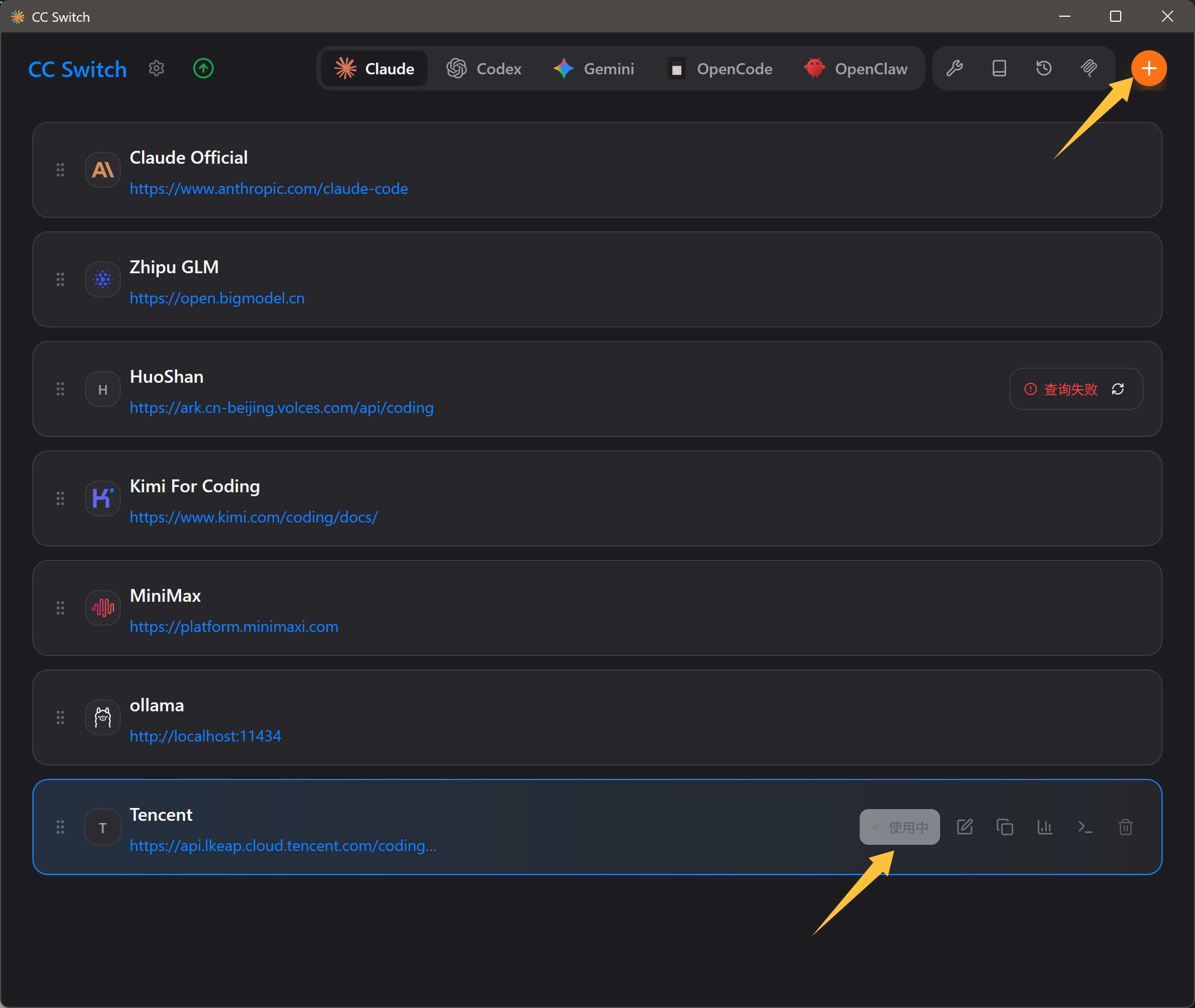

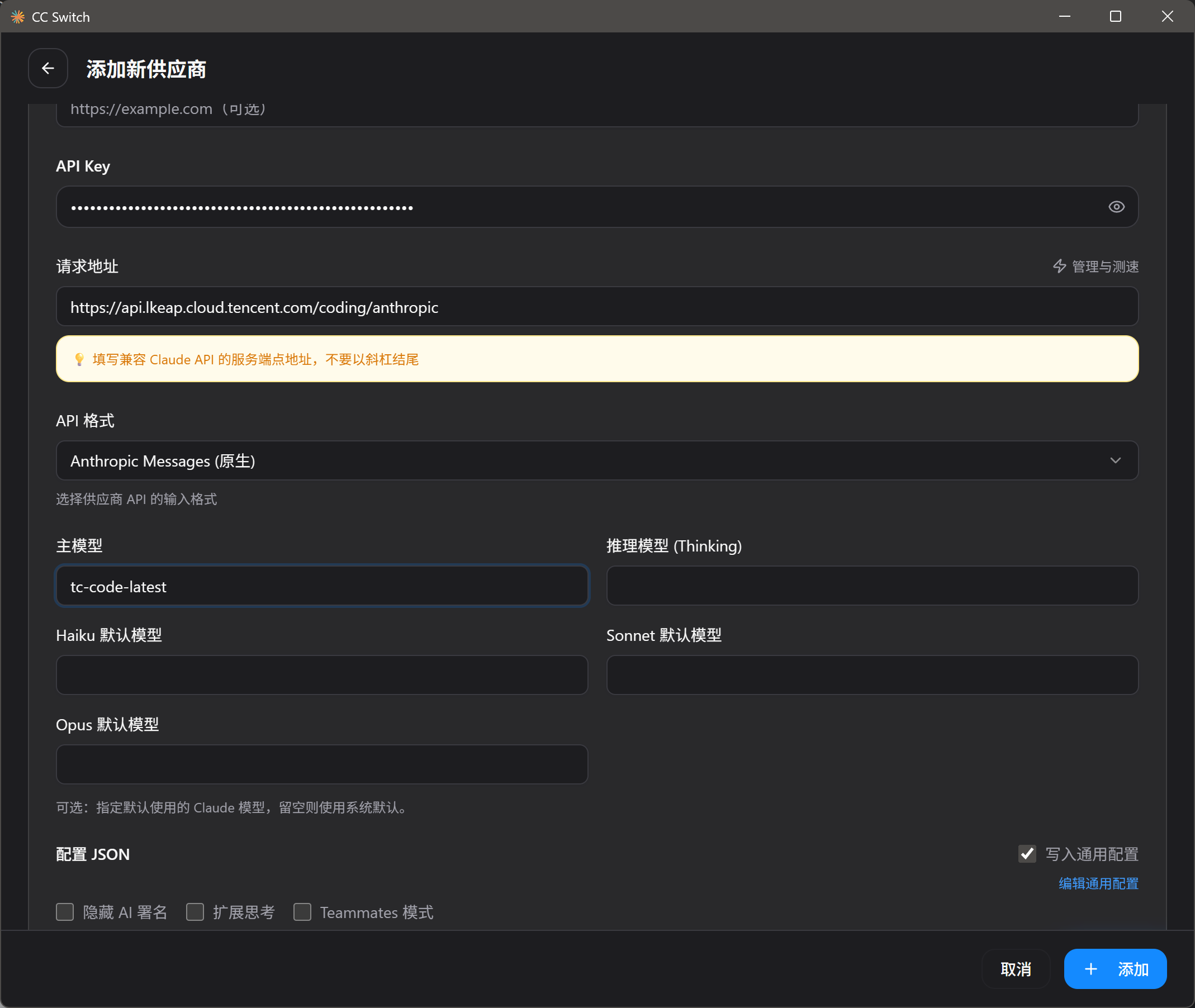

当然,也可以直接用 CC Switch 进行配置:

点击右上角的添加,添加完成之后启用,然后打开 Claude 就可以使用了。

添加的时候可能没有腾讯云的供应商,所以需要选自定义配置。

然后填写一下供应商名字,APIkey,以及请求地址。最后写一下主模型的名字。

然后,我在 CC 中又跑了一次上面的例子。

居然成功了:

只花了14分钟,虽然中间有标红,但是全自动完成,自动启动了web服务。

博客效果如下:

页面布局全部正常,主题切换也正常。

这是 tc-code-latest 牛逼,还是 Claude Code 牛逼啊。 同样的模型在 CodeBuddy 的时候一直报 400 错误,根本干不下去,CC 这里居然用十几分钟搞定了。

两次的差异,是服务稳定性问题,还是模型稳定性问题,还是单纯的运气问题,这个需要后面详细的测试。

目测是产品刚上线还不稳定,我刷新了一下后台,功能页面都升级了:

估计腾讯还在不同优化它的产品,我们后续有时间再好好测试下!

现在wo’de大模型测试平台,以及有足够的选手了。

接下来我会对它们进行严刑拷打,看看谁才是真汉子!